Googleは頭の動きと顔のジェスチャーだけでコンピュータのカーソルを操作できる、オープンソースのハンズフリー・ゲーミングマウスシステム「Project Gameface」を発表しました。

コンピュータゲームは、全世界の誰もが楽しめて人々を結びつける趣味の1つですが、ゲーム周辺機器は、誰もが使えるわけではありません。その垣根を取り払い、障がい者の方々がより簡単にプレイを楽しめるよう支援する動きは活発化しており、マイクロソフトやソニーもアクセシビリティに配慮したゲームコントローラを送り出しています。

この「Project Gameface」も、そうした世の中を良くしようとする流れの1つ。元々の着想は、筋力の低下や運動機能障害が慢性的に進行する筋ジストロフィーを患うビデオゲーム配信者、ランス・カーさんとの出会いから得られたものです。

四肢麻痺のランスさんは、かつてヘッドトラッキングマウスでカーソルを操作していましたが、2021年のある晩、家が火事となり、高価なゲーム機材の一式をすべて炎の中で失ってしまったのです。そこでGoogleにコンタクトを取ったところ、事態が動き出しました。

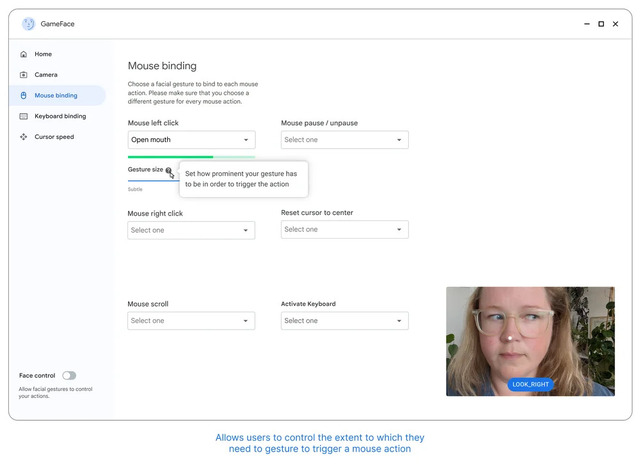

Googleの開発チームは、自社が主導するオープンソースの画像処理技術MediaPipeを使い、「Project Gameface」を作り出しました。ウェブカメラで撮影した頭の動きや顔のジェスチャーを機械学習モデルで認識し、それに応じてカーソルを動かすというもの。高価な機材は必要なく、アクセシビリティのハードルを下げる取り組みです。

その仕組みは、まずユーザーの顔から468の特徴点を持つ3Dメッシュモデルを作成。これら特徴点により顔のジェスチャーから大きめの動きまでをソフトウェアで検出し、違いを判別して、カーソル操作に反映するわけです。

そしてユーザー側では、表情ごとに異なるアクションを割り当てられます。笑顔で左クリック、左眉を上げて右クリック、というぐあい。これらジェスチャー検出は「どの程度、表情を動かすか」のしきい値も設定でき、マウス操作の感度を上げたり、過敏に反応しないよう調整が可能です。

「Project Gameface」のコードはオープンソースで、すでにプレビュー版が公開されています。まだ開発中ですが、特別な機材を要せず安価に構築・維持できるため、より多くのゲーマーを幸せにしたり、あるいはゲームを超えて人々の生活を豊かにする可能性が期待できそうです。