7月30日、動画生成AIサービスの老舗であるRunwayが、最新モデルであるGen-3 AlphaでImage to Videoを使えるようにしました。前日には一部ユーザーが短時間使えるようになったと報告していたものが、正式に実装されました。

早速試してみました。

■Runway Gen-3 AlphaのImage to Videoを試す

動画生成のユーザーインタフェースは、Gen-3 AlphaとGen-2を画面左上から選択できるようになっています。Gen-3 Alphaを選ぶと、画像を選択する画面が表示されます。

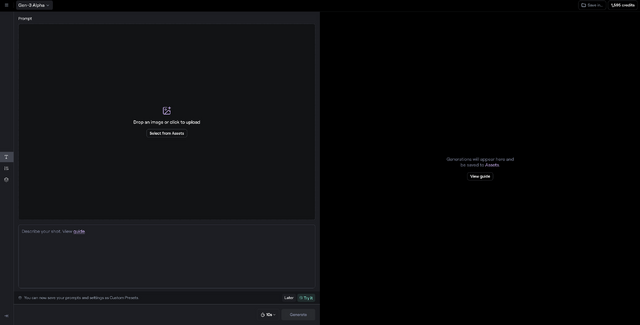

画像を選択すると、Crop image to supported size (1280x768) と、画面をクロップするよう指示されます。現時点では1280x768解像度固定のようです。

クロップすると、プロンプトを記述し(オプションです)、秒数を指定(10秒がデフォルトですが、5秒も選べます)して、Generate(生成)ボタンをクリック。

10秒のクリップが2分かからずに生成されました。10秒という長さを考えると驚異的なスピード。Luma Dream Machineのほぼ2倍です。

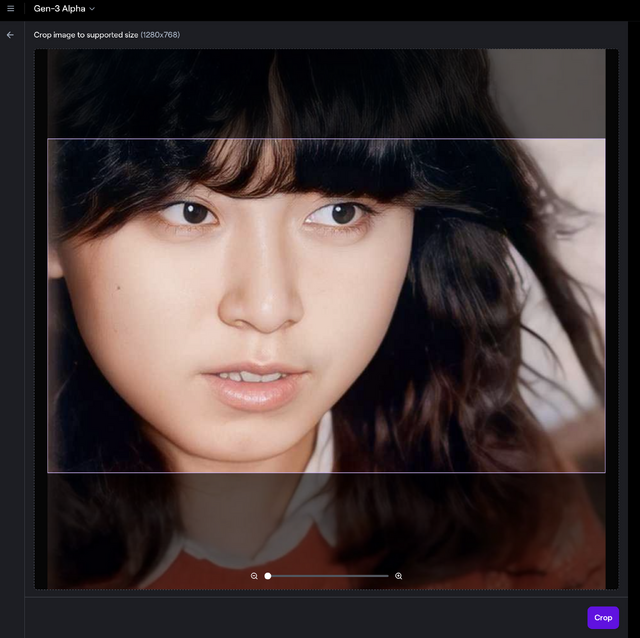

動画が生成されると、画面左下にLip Syncが表示されます。つまり、10秒の長さのリップシンクがいきなりできるということで、Gen-2の機能はそのままに進化したことになります。

このボタンを押すと、20秒ほどで・リップシンクのための準備ができます。すると、オーディオクリップをアップロードするか録音するようにという指示が出るので、元データを入れます。オーディオデータは最大10秒までですが、実はそれより長くなっても構いません。その場合には動画がループします。

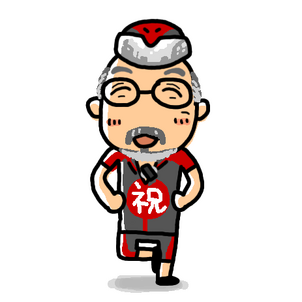

(▲リップシンク生成)

出来上がったのがこちら。やはり欧米化は起きてしまいます。やたらまつ毛が長くなり、骨格が変わってゴツくなってしまいます。まあこれは学習モデルの問題なので仕方ないのでしょうね。

同じImage to Videoでも、KLINGの方がはるかに自然なのです。日本人のImage to Videoについては、やはりKLINGが最強。こちらのリップシンク機能の搭載を待つ方が良いのでしょうか。機能的には10秒生成、Image to Video、リップシンクと揃っているのですが。

別の画像で再度挑戦してみました。こちらは欧米化せずに、うまくいったようです。プロンプトでsingingの代わりにtalkingとしたおかげで変に瞼を閉じたりおおげさな表現にならなかったのが功を奏したのかもしれません。

欧米化してしまった画像からのImage to Videoに、プロンプトをsingingからtalkingに変えて再挑戦してみました。あら不思議。今度はうまく行きました。あまり喋ってくれていませんが。ではこれでリップシンクもいってみましょう。

かなりうまくいった方だと思います。欧米化はプロンプトである程度防げるけれども、完全ではない感じですね。もう少し修行を積んできます。

難易度の高いピアノ演奏も結構うまくできているようです。

うまくいったものだけをつなぎ合わせてみました。プロンプトを工夫してある程度ガチャを回せば、HeyGenのExpressive Photo Avatarと組み合わせると、ミュージックビデオを作りやすくなると思います。

おまけ。筆者の昔の演奏写真をGen-3 AlphaにImage to Videoして、Sunoで作った曲にリップシンクしてみました。ギターの演奏は合ってないけど。

最終的に、ミュージックビデオはこうなりました。

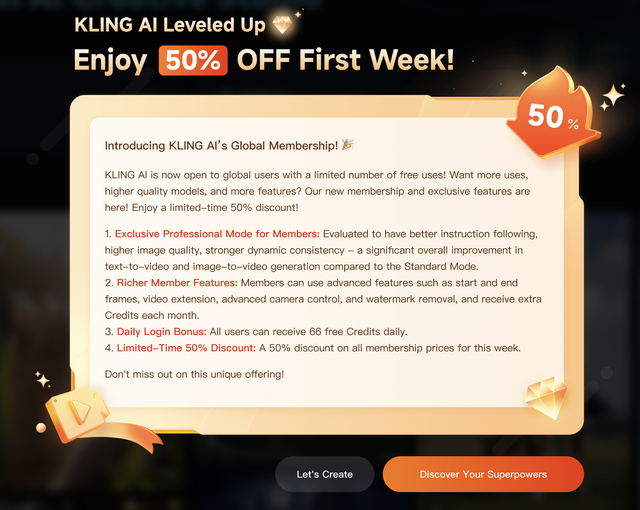

最後のクリップだけはGen-3 Alphaではなく、KLINGで作っています。なぜかというと、KLINGがサブスクリプションプランを発表し、そこでフレーム中割り機能を実装したからです。

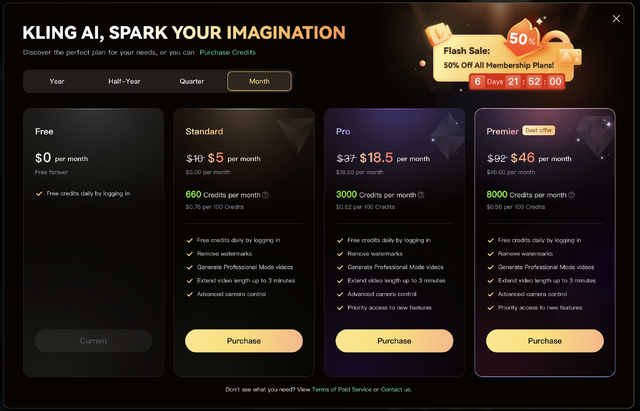

有料プランはStandard、Pro、Premierがありますが、Proプラン以上では品質、動きの一貫性などが向上しているそうです。

期間限定で半額セールとなっています。筆者は月額コースのProプランにしましたが、半額となると年間契約のほうがいいかもです。

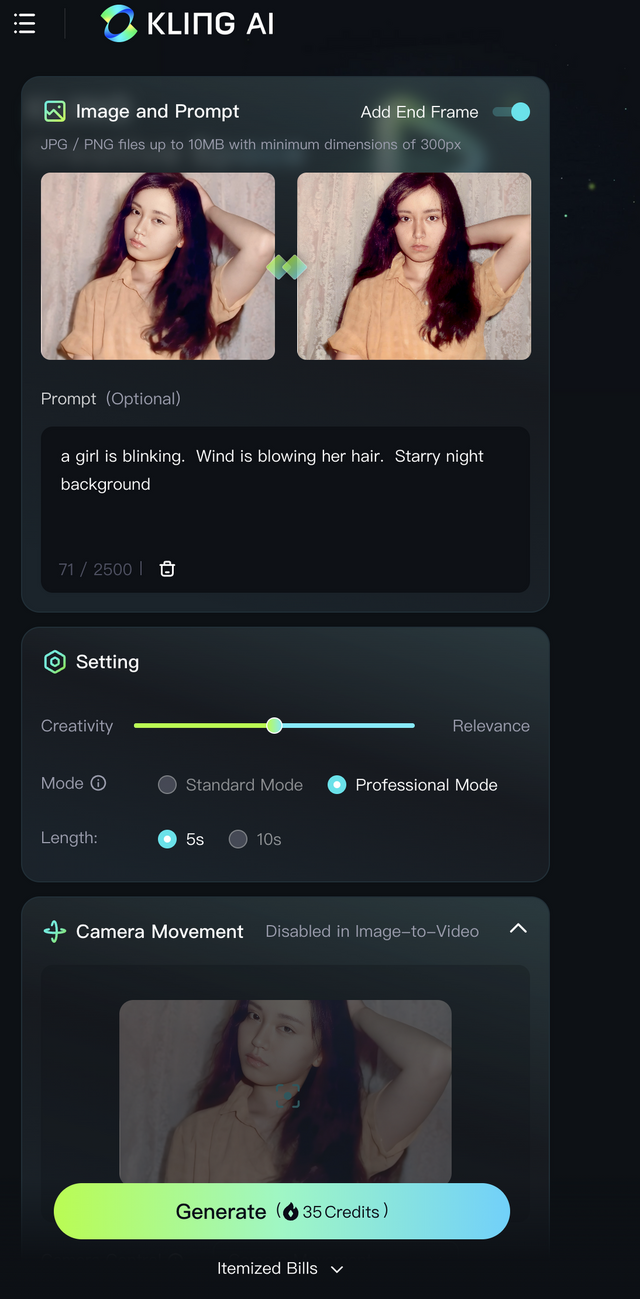

Image to Videoで、End Frameを設定可能になり、Luma Dream Machineでしかできなかった中割り機能が可能になっています。

ただし、Image to Videoでは10秒の生成はできず、5秒に限定されています。