今回の生成AI論文ピックアップでは、3億枚以上の人間画像データで学習した動く人を高精度に理解するMeta Reality Labsの「Sapiens」を取り上げます。

生成AIウィークリー連載記事一覧 | テクノエッジ TechnoEdge

動く人間を詳細に理解できるMetaのビジョンモデル「Sapiens」、3億枚以上の人間画像データで学習

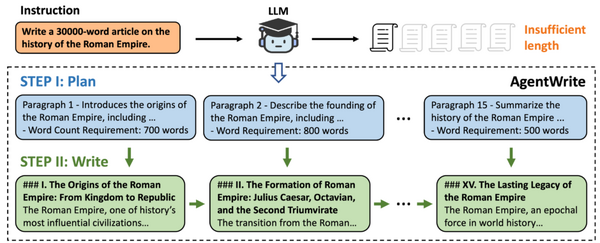

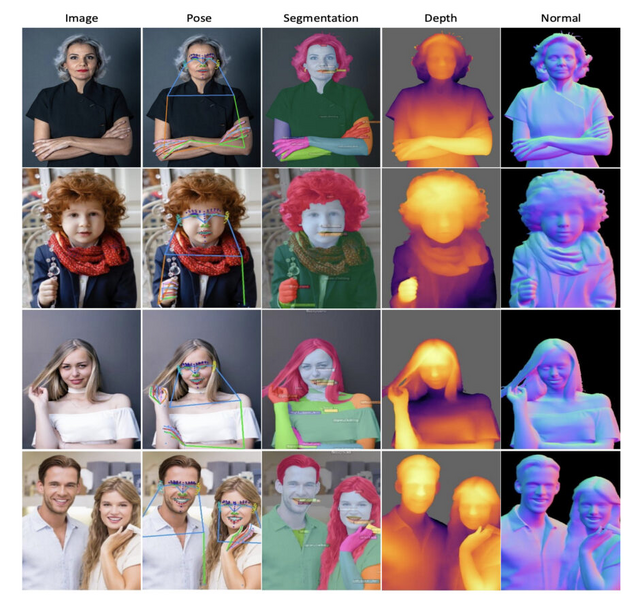

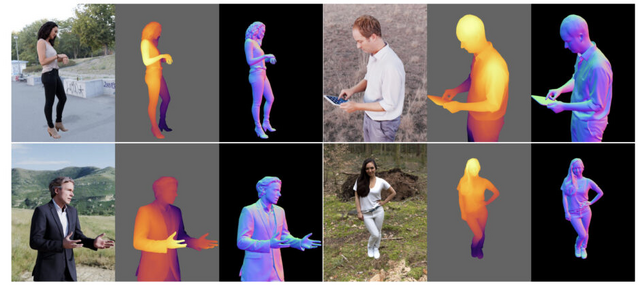

この研究は、人間中心のビジョンモデルファミリー「Sapiens」について紹介しています。Sapiensは、0.3Bから2Bまで用意されており、2Dポーズ推定、身体パーツのセグメンテーション、深度推定、表面法線予測という4つの基本的な人間中心のビジョンタスクに対応しています。

Sapiensモデルは、3億枚以上の人間画像を含むデータセット「Humans-300M」を用いて事前学習されています。この大規模な事前学習により、モデルは様々な状況下での人間の姿勢や形状を理解できるようになりました。

Sapiens-2Bモデルは、ポーズ推定、パーツセグメンテーション、深度推定、法線推定の全てのタスクにおいて、既存の最先端モデルを大幅に上回る性能を達成しました。

特に、ポーズ推定では従来の記録を大幅に更新し、パーツセグメンテーションでも非常に高い精度を達成しています。深度推定と法線推定においては、単一人物画像と複数人物画像の両方で既存の手法を大きく上回る結果を示しました。

Sapiensの特筆すべき点は、1024×1024ピクセルという高解像度での推論に対応していることです。これにより、人間の細かな特徴や動きまで捉えることができます。また、シンプルなモデル設計を採用しているため、パラメータ数を3億から20億まで拡張しても、各タスクでの性能が向上し続けることが確認されています。