中国のDeepSeekチームが、OpenAI o1相当の精度を持つMITライセンスで商用利用も可能なオープンソースモデル「DeepSeek-R1」を発表しました。

ByteDanceがMoEアーキテクチャにより少ないパラメータで高性能を実現するAIモデル「Doubao-1.5-pro」を発表しました。「Deep Thinking」モードを搭載し、AIMEベンチマークでOpenAIのo1-previewおよびo1モデルを上回ります。

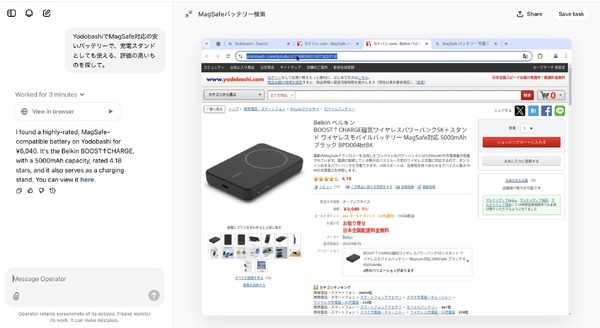

OpenAIがブラウザを操作してタスクを実行するAIエージェント「Operator」を発表しました。入力テキストに応じてブラウザ上で指示通りに動作してくれます。

さて、この1週間の気になる生成AI技術・研究をいくつかピックアップして解説する「生成AIウィークリー」(第80回)では、1枚の画像やテキストから高解像度のテクスチャ付き3Dアセットを生成するAIモデル「Hunyuan3D 2.0」や、ByteDanceのブラウザを自動操作するAIエージェント「UI-TARS」を取り上げます。

また、強化学習を用いたマルチモーダル言語モデル「Kimi k1.5」や、深く考えるAIに拡張するGoogle開発のアプローチ「Mind Evolution」をご紹介します。

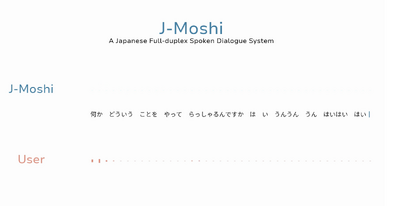

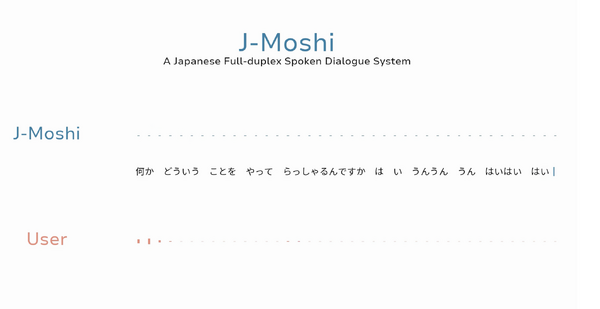

そして、生成AIウィークリーの中でも特に興味深いAI技術や研究にスポットライトを当てる「生成AIクローズアップ」では、人間同士の自然な会話で見られる発話の重なり(オーバーラップ)や相槌などの同時双方向的な特徴を再現できる日本語専用リアルタイム音声会話AI「J-Moshi」を単体記事で掘り下げています。

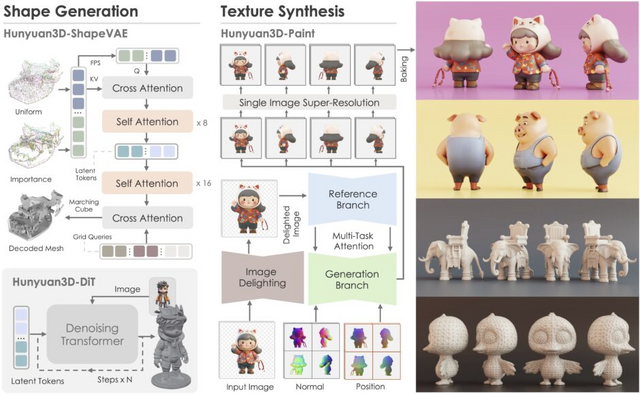

画像1枚やテキストから高解像度のテクスチャ付き3Dアセットを生成するシステム「Hunyuan3D 2.0」をテンセントが開発

中国のTencentが「Hunyuan3D 2.0」という3Dアセット生成システムを発表しました。このシステムは単一の画像やテキストから高品質な3Dモデルとテクスチャを生成することができます。

このシステムは主に2つの重要なコンポーネントで構成されています。1つ目は「Hunyuan3D-DiT」と呼ばれる形状生成モデルで、入力画像から3Dメッシュを生成します。2つ目は「Hunyuan3D-Paint」と呼ばれるテクスチャ合成モデルで、生成されたメッシュに対して高解像度のテクスチャを生成します。

また、このシステムには「Hunyuan3D-Studio」という制御プラットフォームが付属しており、プロフェッショナルからアマチュアまで、誰でも簡単に3Dアセットを作成・編集できる環境を提供しています。

特筆すべき機能として、手書きのスケッチから3Dモデルを生成する機能、ローポリゴンスタイライゼーション機能、3Dキャラクターアニメーション機能などが実装されています。

研究チームが実施した評価実験では、Hunyuan3D 2.0は既存のオープンソースモデルや非公開モデルと比較して、幾何学的な詳細さ、入力画像との一致度、テクスチャの品質などの面で優れた性能を示しました。

Hunyuan3D 2.0: Scaling Diffusion Models for High Resolution Textured 3D Assets Generation

Zibo Zhao, Zeqiang Lai, Qingxiang Lin, Yunfei Zhao, Haolin Liu, Shuhui Yang, Yifei Feng, Mingxin Yang, Sheng Zhang, Xianghui Yang, Huiwen Shi, Sicong Liu, Junta Wu, Yihang Lian, Fan Yang, Ruining Tang, Zebin He, Xinzhou Wang, Jian Liu, Xuhui Zuo, Zhuo Chen, Biwen Lei, Haohan Weng, Jing Xu, Yiling Zhu, Xinhai Liu, Lixin Xu, Changrong Hu, Tianyu Huang, Lifu Wang, Jihong Zhang, Meng Chen, Liang Dong, Yiwen Jia, Yulin Cai, Jiaao Yu, Yixuan Tang, Hao Zhang, Zheng Ye, Peng He, Runzhou Wu, Chao Zhang, Yonghao Tan, Jie Xiao, Yangyu Tao, Jianchen Zhu, Jinbao Xue, Kai Liu, Chongqing Zhao, Xinming Wu, Zhichao Hu, Lei Qin, Jianbing Peng, Zhan Li, Minghui Chen, Xipeng Zhang, Lin Niu, Paige Wang, Yingkai Wang, Haozhao Kuang, Zhongyi Fan, Xu Zheng, Weihao Zhuang, YingPing He, Tian Liu, Yong Yang, Di Wang, Yuhong Liu, Jie Jiang, Jingwei Huang, Chunchao Guo (refer to the report for detailed contributions)

Project | Paper | GitHub

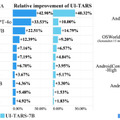

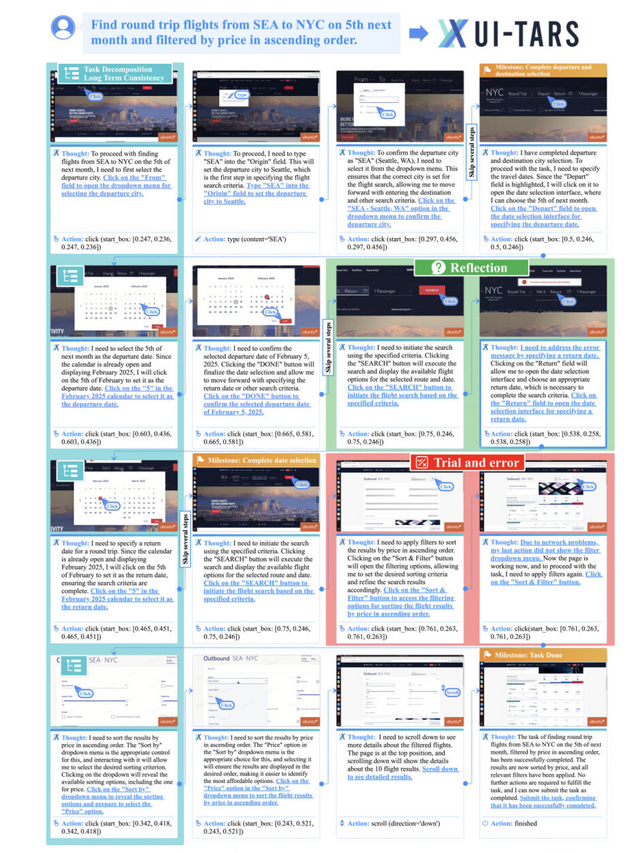

ブラウザを自動操作するAIエージェント「UI-TARS」をByteDanceが発表

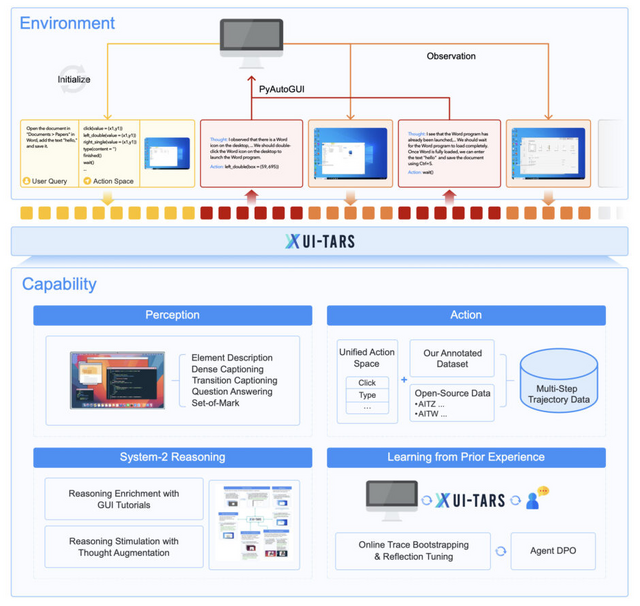

GUIを自動操作するAIシステム、すなわちGUIエージェントの研究が大きく進展しています。これまでのGUIエージェントには2つの大きな問題がありました。1つ目は、HTMLなどのテキストデータに依存していたため、異なるシステム間での互換性が低かったことです。2つ目は、画面認識や操作判断など、それぞれの機能が別々のモジュールとして開発されていたため、新しい状況への対応が難しかったことです。

これらの課題を解決するため、研究は2つの方向へと進化しています。第一に、テキストデータではなく画面のスクリーンショットだけを見て操作を行う「ピュアビジョン方式」への移行です。これにより、人間が画面を見て操作する時と同じような仕組みが実現できます。第二に、複数の機能を一つの大規模AIモデルに統合する「エンドツーエンド方式」の採用です。

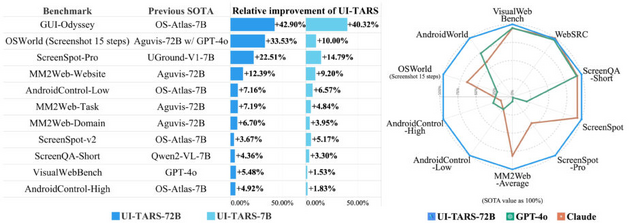

研究チームが開発した「UI-TARS」は、これらの新しいアプローチを実装した最新のGUIエージェントです。UI-TARSの特徴は、高度な画面認識能力、正確な操作実行、論理的な意思決定能力、そして経験から学習する機能を備えていることです。

実験では、UI-TARSは10種類以上のベンチマークテストで最高性能を記録しました。特に720億パラメータを持つモデルでは、OSWorldベンチマークでClaudeを凌駕。AndroidWorldベンチマークでは、GPT-4oを上回る結果を示しています。

UI-TARS: Pioneering Automated GUI Interaction with Native Agents

Yujia Qin, Yining Ye, Junjie Fang, Haoming Wang, Shihao Liang, Shizuo Tian, Junda Zhang, Jiahao Li, Yunxin Li, Shijue Huang, Wanjun Zhong, Kuanye Li, Jiale Yang, Yu Miao, Woyu Lin, Longxiang Liu, Xu Jiang, Qianli Ma, Jingyu Li, Xiaojun Xiao, Kai Cai, Chuang Li, Yaowei Zheng, Chaolin Jin, Chen Li, Xiao Zhou, Minchao Wang, Haoli Chen, Zhaojian Li, Haihua Yang, Haifeng Liu, Feng Lin, Tao Peng, Xin Liu, Guang Shi

Paper | GitHub

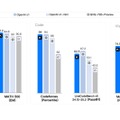

o1と同等の性能を持つ強化学習を用いたマルチモーダル言語モデル「Kimi k1.5」

大規模言語モデルの訓練は、これまでモデルパラメータとデータ規模を拡大することで性能向上を図ってきましたが、高品質な訓練データの量に制限があるという課題がありました。

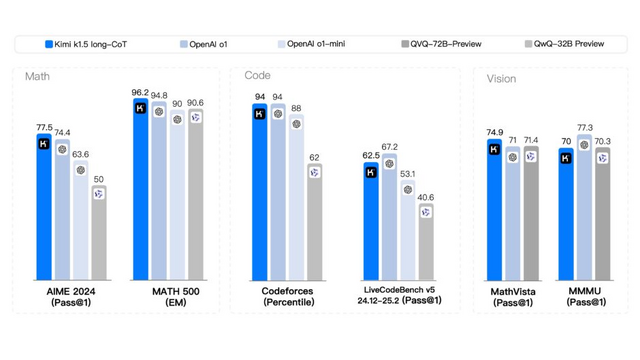

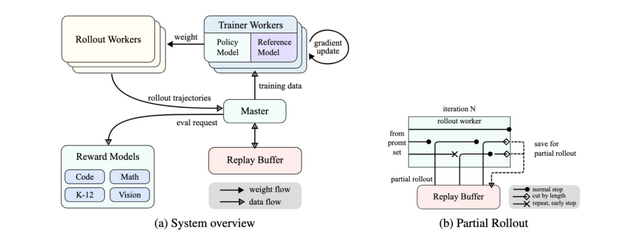

中国のKimiチームは、この制限を克服するため、強化学習(RL)を活用した最新のマルチモーダル言語モデル「Kimi k1.5」を開発いたしました。RLを用いることで、モデルは報酬に基づいて探索的に学習でき、既存のデータセットの制約を超えることが可能となっています。

Kimi k1.5は、128kトークンまでの長文処理能力、効率的な強化学習手法、シンプルな学習の枠組み、そしてテキストと画像の両方を扱えるマルチモーダル性を特徴としています。

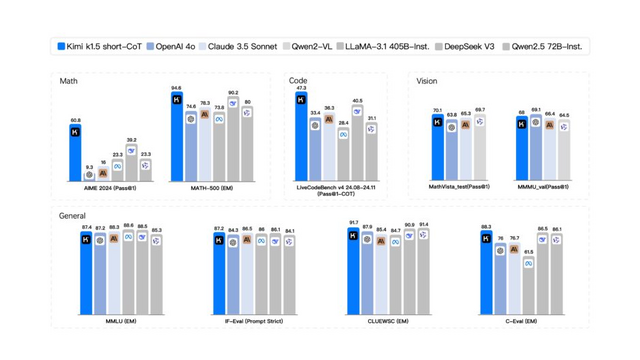

Kimi k1.5は、複数のベンチマークテストで最高水準の性能を達成し、OpenAIのo1と同等の性能を示しています。また、長い推論過程を短く効率化する技術により、GPT-4oやClaude 3.5 Sonnetを大きく上回る性能向上を実現しました。

Kimi k1.5: Scaling Reinforcement Learning with LLMs

Kimi Team, Angang Du, Bofei Gao, Bowei Xing, Changjiu Jiang, Cheng Chen, Cheng Li, Chenjun Xiao, Chenzhuang Du, Chonghua Liao, Chuning Tang, Congcong Wang, Dehao Zhang, Enming Yuan, Enzhe Lu, Fengxiang Tang, Flood Sung, Guangda Wei, Guokun Lai, Haiqing Guo, Han Zhu, Hao Ding, Hao Hu, Hao Yang, Hao Zhang, Haotian Yao, Haotian Zhao, Haoyu Lu, Haoze Li, Haozhen Yu, Hongcheng Gao, Huabin Zheng, Huan Yuan, Jia Chen, Jianhang Guo, Jianlin Su, Jianzhou Wang, Jie Zhao, Jin Zhang, Jingyuan Liu, Junjie Yan, Junyan Wu, Lidong Shi, Ling Ye, Longhui Yu, Mengnan Dong, Neo Zhang, Ningchen Ma, Qiwei Pan, Qucheng Gong, Shaowei Liu, Shengling Ma, Shupeng Wei, Sihan Cao, Siying Huang, Tao Jiang, Weihao Gao, Weimin Xiong, Weiran He, Weixiao Huang, Wenhao Wu, Wenyang He, Xianghui Wei, Xianqing Jia, Xingzhe Wu, Xinran Xu, Xinxing Zu, Xinyu Zhou, Xuehai Pan, Y. Charles, Yang Li, Yangyang Hu, Yangyang Liu, Yanru Chen, Yejie Wang, Yibo Liu, Yidao Qin, Yifeng Liu, Ying Yang, Yiping Bao, Yulun Du, Yuxin Wu, Yuzhi Wang, Zaida Zhou, Zhaoji Wang, Zhaowei Li, Zhen Zhu, Zheng Zhang, Zhexu Wang, Zhilin Yang, Zhiqi Huang, Zihao Huang, Ziyao Xu, Zonghan Yang

Paper | GitHub

Google、深く考えるAIに拡張する手法「Mind Evolution」を発表

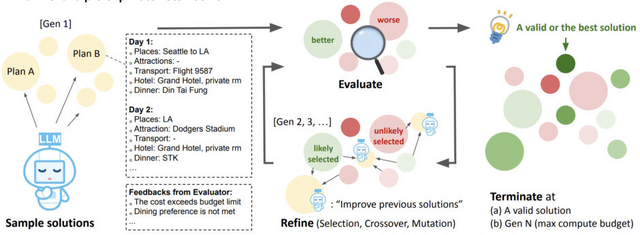

Google DeepMindの研究チームが、大規模言語モデル(LLM)の推論能力向上を目指す新手法「Mind Evolution」を発表しました。

Mind Evolutionの特徴は、LLMが生成した複数の解候補を並行して改良し、優れた特徴を持つ解を組み合わせながら質の高い解を探索する点です。また、形式的な問題定義を必要とせず、自然言語での指示だけで複雑な制約条件を満たす解を見つけることができます。

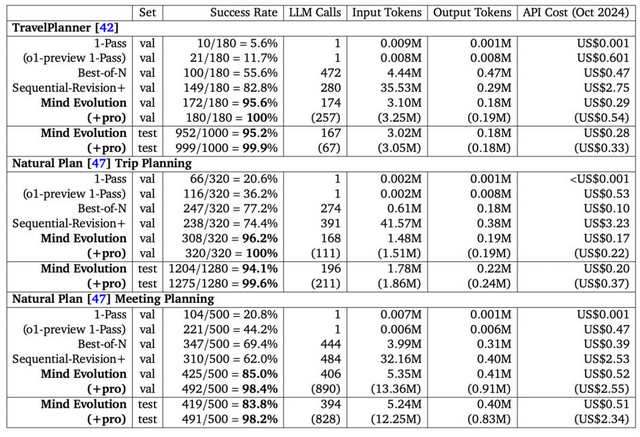

この手法は、LLMが生成した複数の回答案を進化的アルゴリズムで改良していくもので、特に自然言語による計画立案タスクで高い性能を示しています。研究チームは、旅行プランの作成や会議のスケジューリングなどのベンチマークテストで、従来手法と比較して大幅な精度向上を達成しました。

具体的には、TravelPlannerベンチマークでは、Gemini 1.5 Flashモデルを用いて95.6%の成功率を達成し、Meeting Planningで85.0%を達成しました。通常のGemini 1.5 Flashモデルでは、TravelPlannerで5.6%、Meeting Planningで20.8%の成功率しか達成できません。

さらに、未解決の問題事例をGemini 1.5 ProによるMind Evolutionで後続的に取り組む2段階アプローチを実験したところ、TravelPlannerで100%、Meeting Planningで98.4%の成功を達成しました。

Evolving Deeper LLM Thinking

Kuang-Huei Lee, Ian Fischer, Yueh-Hua Wu, Dave Marwood, Shumeet Baluja, Dale Schuurmans, Xinyun Chen

Paper