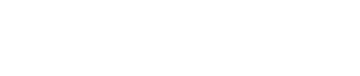

Googleの共同創業者、サーゲイ・ブリンさんがGoogle I/O 2012で華々しく「Google Glass」を披露してから12年。Googleは2024年12月11日に「Project Astra」を、12日には「Android XR」を発表しました。

(▲Google I/O 2012でGoogle Glassを披露するブリンさん)

Project Astraは、Google DeepMindが開発した、「普遍的なAIアシスタントの将来の機能を探求する研究プロトタイプ」。今年のGoogle I/Oでチラ見せされていましたが、「Gemini 2.0」の発表と同時に、そのプロジェクトの一環という形でテスターがスマートフォンで使っている動画が公開されました。

Android XRは、GoogleがSamsungとQualcommと共同で開発した、拡張現実(XR)のヘッドセットや眼鏡向けの新しいOSです。

この2つを組み合わせれば、ブリンさんが目指したスマートグラスに近いものが実現しそうです。

その鍵となるのは生成AIの「Gemini」。Geminiは2.0になり、画像と音声の出力をサポートし、Google検索などのツールを呼び出せるようになりました。レイテンシーも改善され、AIアシスタントとの会話がより自然にできるようになった、とGoogleは説明しています。

(▲Gemini 2.0)

ブリンさんがGoogle Glassを発表した当時、Googleは既にAIの研究に着手していました(Googleが「Solve for X」部門を立ち上げたのは2012年、DeepMindを買収したのは2014年)が、まだまだな状態でした。Google Glassは早すぎたのです。

以下は、12年前にGoogleが公開した「Project Glass: One day...」というタイトルの動画です。ARメガネをかけて朝起きて、お天気やその日の予定を確認したり、Googleマップのナビを使ったり、ライブのポスターを見てチケットを購入したり、写真を撮ってSNS(当時はまだGoogle+があった)に投稿したり、着信に応答したり。

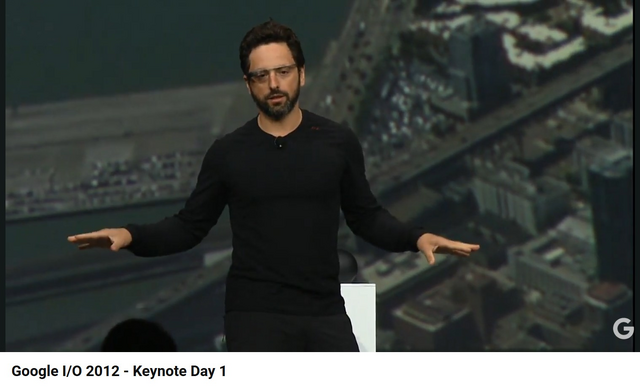

12日に公開されたプロトタイプでのデモ動画では、少なくともGoogleマップのナビは実現できるようです。さらに、One day動画にはなかった同時通訳やリアルタイムチュートリアル(企業向けGoogle Glassにはあった、視界にある機械などの操作や組み立ての方法をリアルタイムで教えてくれる機能)もできています。

米メディア向けに開かれたAndroid XRの発表イベントに参加した人たちの話によると、プロトタイプのメガネには、サングラスや透明レンズのものがあり、MetaのRay-Ban Metaと同様に度付きにもできるようです(Googleは2020年にARメガネ企業のNorthを買収しています)。

(▲これが実際のプロトタイプかは不明ですが、デモ動画に出ているスマートグラス)

処理はペアリングしたスマートフォンで行われるので、メガネ自体はコンパクトで、バッテリーの持ちもよくなっています。プロトタイプ段階では、単眼ディスプレイのメガネやディスプレイがなくてGeminiと会話するだけのメガネもあったそうです。フレームの側面をタップするとディスプレイがアクティブになるところは以前のモデルに近いかも。

Geminiの使い方の例としては、

・美術館で絵画を見ながらその絵について説明するようお願いすると、作者やその絵についての解説をしてくれる

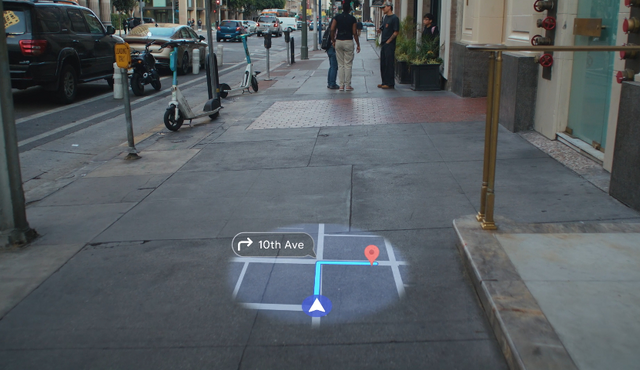

・設定した言語以外の言語で書かれたメニューや標識を見ると翻訳してくれる

・音声の入出力もできるので、異国の人の話す言葉をリアルタイムで母国語に翻訳してくれる(音声ではなくテキストが相手の顔の下に表示されるそうです)

・その他、音楽の再生や着信電話の概要表示などもできる

(▲店員さんの韓国語をリアルタイムで英語の字幕に)

これが数年後に市販されるとしたら、すっごく楽しみです。高そうだけど、たぶん買っちゃう。

これは、Googleが苦節十数年、AR/VR/XRとAIに湯水のようにお金と人材を投入してきた成果です。お金持ちだからこそできたこと。

Googleに対して独禁法違反で企業分割する動きがあります。米司法省が提案しているChrome売却などの制裁措置について、来年の夏には裁判所の決定が下される予定。確かに1企業が大きな力を持ちすぎるのは危険かもしれないけれど、Googleは、大量のリソースが必要な技術開発が、金銭的にも技術的にもモチベーション的にも可能な数少ない企業。技術推進を優先してほしいなぁと個人的には思います。

もうひとつの心配事は、「今度こそ途中でやめたりしないでね」ということ。Googleの墓場は有名です。

さらに、実はこちらが個人的には心配なんですが、Google DeeepMindとAndroidチームがうまく連携するんだろうか、ということ。

Project Astraの発表でAndroid XRというワードが出てこなかったのは、未発表だったから分かりますが、Android XRの発表でProject Astraに(少なくとも公式ブログで一言も)触れなかったのはとても不思議。

Project Astraの公式ブログでは、「We’re working to bring these types of capabilities to Google products like Gemini app, our AI assistant, and to other form factors like glasses.」と書かれているので、Project Astraは、Android XR上で動作するように設計されているのでしょう。

でもこれまで、AndroidとNest、AndroidとChromeOSなど、別チームとの連携がいまひとつうまくいかない例がいくつかあったので、心配になります。

Android XRについては、Google内だけでなくSamsungや他のメーカー、サードパーティの開発者も巻き込んだ“エコシステム”で展開していく計画ではありますが。以前のDayDreamのHTCとかの記憶が蘇っちゃいます。。。

まあ、不安要素はいろいろありますが、今度こそ実現してほしいなぁ、理想のスマートメガネ。

(▲もう1つは、ディスプレイの位置が真ん中の下の方だと目が寄らないか、ということ。イラスト:ばじぃ)

余談ですが、ブリンさんの近況について検索していたら、世界一巨大なスーパーヨット「Dragonfly」を約4億5000万ドルで買ったという記事がありました。ヨットといっても、船上にヘリポートが2つ、プールが複数あって、乗客は40人乗れるという豪華客船。もちろんStarlinkアンテナ装備でいつでもネットに接続できる(はず)。相変わらずスケールがでかいです。まだ51歳なので、また面白いことをやってほしいところ。

(▲ヨットメーカーLürssen Yachtsのプレスリリースに掲載されたDragonfly)