動画生成AIは、OpenAIのSoraが2023年2月に発表されたことに端を発し、そこで発表されたサンプル動画に追いつけとばかりに、Luma Dream Machine、Runway Gen-3、KLING、Vidu、Hailuoといったライバルが競ってきました。

PikaはSora発表までは先頭集団にいたものの、他のAI企業が先進的機能を発表していたのに対し、画像生成エンジンをアップデートしないまま出遅れた状態でいたところを、画像を爆発させたり首チョンパしたりという過激なPikaffectsという一発芸機能で盛り返し、最近では本道の画像生成エンジンも地道に向上させています。

Soraは昨年末に毎月3万円払えば使えるモードで一般公開し、20秒を一気に生成できるということで注目を集めましたが、実際に使ってみると、一貫性に乏しく、例えば人物画像のImage to Videoであれば、最後までその人物でいることはほとんどなく、20秒とはいっても使えるのはせいぜい10秒程度というがっかりな状況です。

一貫性を保ったままである程度の長さの動画を生成することの難しさがこれでわかるというものです。

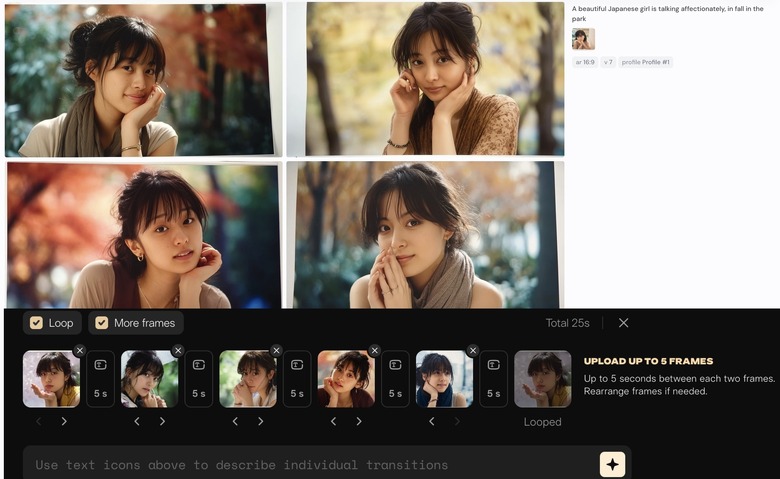

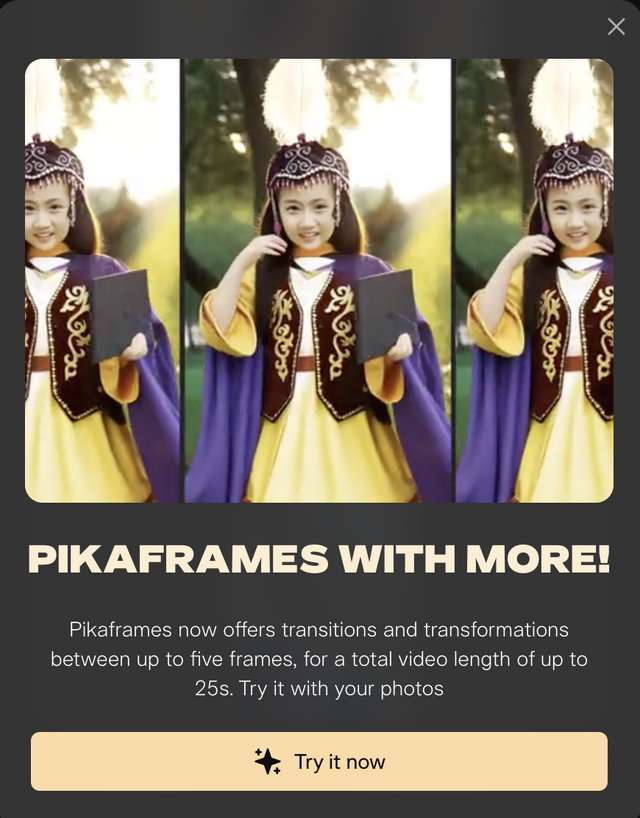

そんな中、AI動画生成を「25秒まで生成できます」「5フレーム分の画像から生成できます」というところが現れました。それがPikaのPikaframesです。

どちらもできたら便利な技術です。Pikaframesはこれまで、スタートとエンドの2枚のフレームのみをサポートしていましたが、それが5枚になるということ。フレーム補完は現在、Runway Gen-3が最近3枚のフレームが使えるようになったくらいですし、事実上、現在の動画の長さの上限が10秒ということを考えると、一貫性を保ったままで25秒まで行けるというのなら使わない手はないでしょう。

最後のフレームから拡張する手法で10秒ずつ伸ばせるRunwayなどもありますが、やはり手間がかかりますし、その前の10秒と時の流れや動きが違ったりします。

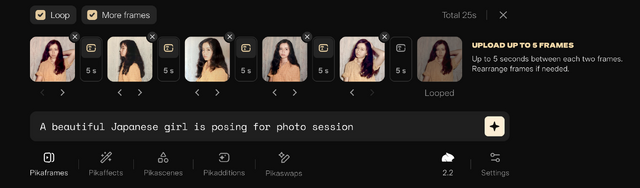

というわけで、実際にPikaで試してみました。しかし、すぐに分かったのは、25秒まで生成できるのは、5枚分のフレームをフルに使った場合、ということ。

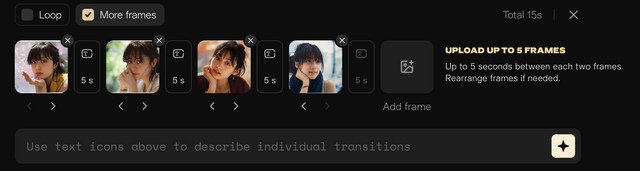

5枚の静止画を配置し、それぞれのフレーム間補完を最大5秒ずつ行うのです。つまり、5枚を使っただけだと最大20秒。さらに最初のフレームに戻るループオプションを入れると、さらに5秒増えて25秒になるという仕組み。

合計6枚を使ってそれぞれのトランジション時間を最大5秒にすると、25秒になるというわけです。

(▲5枚をフルで使ってさらにループさせることで25秒に到達)

Soraなどではストーリーボードを使って、テキストプロンプトで動画の展開を記述するオプションがありますが、それを絵コンテだけでやってしまう感じでしょうか。トランジション時間を秒単位でコントロールのは便利ですが、その分合計時間は減ることになります。

ChatGPT 4oのレファレンス画像生成を使って、人物のポージングをコントロールしながらフレーム用の画像を作っていくと効果的かもしれません。ただ、現状の4o画像生成は、元画像から変更してできた人物があまり魅力的ではなくなってしまうんですよね……。

今回は、Midjourney V7で妻の写真を人物レファレンスしてプロンプトで四季を背景に描くよう指示して、春・夏・秋・冬のフレームを生成。これらをスムーズに遷移させる15秒のクリップを作りました。

このレファレンス機能はドラフトモードと併用できないのがちょっと残念ポイント。

高い一貫性で評価の高いRunwayの新モデルGen-4、最近リップシンクの動画が安定してきたHeyGen、日本人の表情なら鉄板のKLINGやHailuo、そして今回のPikaframesなどを駆使して、1曲分のミュージックビデオを作ってみました。

曲自体の制作も、ヤマハの新しいiOSアプリ「Extrack」でコード進行解析してLogic ProのSession Playersと組み合わせる面白い実験ができたので、AI音楽制作のワークフローについては改めて記事にしたいと思います。

そして、20秒の動画を生成できるという触れ込みだったSoraを改めて使ってみたところ、やはりImage to Videoだと一貫性が10秒も持たず、Pikaにも及ばずという結果に。結局、ミュージックビデオに入れる余地はありませんでした。

Pikaframesは、別の動きの大きい動画生成サービス、例えばViduやHailuoなどでいったん生成したものから静止画を取り出し、フレームとして再配置すれば、ちょっと手間ですが、意図した動画ができそう。

これからは積極的に使っていこうと思います。