「VOCALOID β-STUDIO」の試用申し込み受け付けが開始されたという記事を書くとともに、実際に申し込みもしていました。リリース前の協力者による作例が少しずつ公開されてきた23日、初回受付分からの抽選が行われ、筆者は運良く当選しました。

著名ボカロPで外れた方もいらしたようなので、かなりの難関だった模様ですが、せっかく試す機会を得られたので、まずはインプレッションを書いてみようと思います。

Cubaseユーザー以外の使い勝手

VOCALOIDを開発するヤマハにとって、Cubaseを開発している独Steinbergは子会社。ヤマハのDAWにはCubase LEのライセンスが付属するなど、強い連携をしています。VOCALOIDと連動するVOCALOID Editor for Cubaseも早くから提供されていて、「VOCALOIDを使うならCubase」となるのは当然のことでしょう。それはVOCALOID β-STUDIOでも同様で、DAW内で歌詞付きノートを作成・修正できるのはCubaseだけ。VOCALOID β-STUDIOにはスタンドアロンのエディターがない分、よりその格差は大きく感じられます。

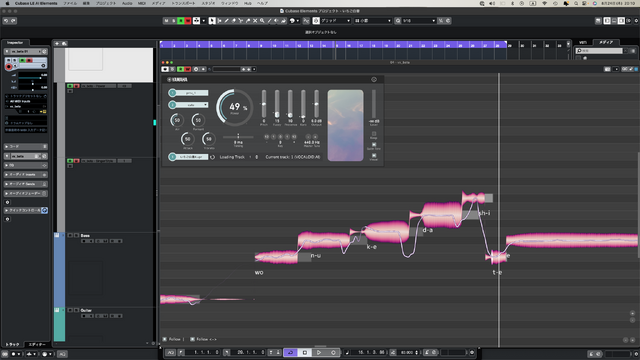

筆者もこのためにCubaseをメインマシンにインストールしてはみたものの、やはり慣れた環境でないと音楽制作はしにくく(操作を覚えられない)、とりあえずLogic Proで始めてみることにしました。

▲Cubaseにインストールはしてみた

そう。筆者のメインDAW(音楽制作ソフト)はAppleのLogic Proです。iPad版GarageBandで大体のトラックを作っておいて、プロジェクトをMacのLogic Proに読み込んでボーカルレコーディングと修正を行うというフローでいます。

以前と違い、最近の歌声合成ソフトはほとんどがMacに対応しているので、それぞれのスタンドアロンのエディターがあれば、それをLogic Proに読み込み、ピッチ調整機能であるFlexPitchで細かい修正を行うことで済んでしまいます。

Logic Pro(のMac版)は、このFlexPitchが内蔵されているという点が他のDAWに対して優位なポイントで、ピッチやタイミングが少々おかしくても、DAWの中で簡単に直せてしまうのです。Cubaseだと上位エディションのProやArtistはVariPhraseという同等の機能が使えますが、それ以外のDAWは、Melodyneなどのプラグインを別途購入して使う必要があります。

ボカロPには、VOCALOID Editor上で細かい調教はせずに、Melodyne(などのピッチ補正ツール)で全部やっちゃえばいいのよといった派閥もあります。

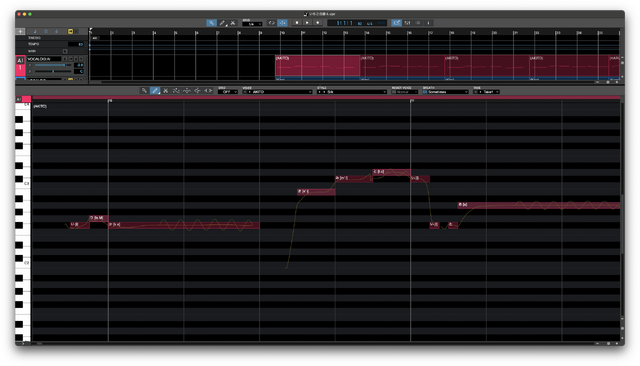

今回は使い慣れたボーカルエディターであるVOCALOID6 Editorを使って作ったボーカルデータ(.vpr)をまず用意しました。

▲VOCALOID6 Editor

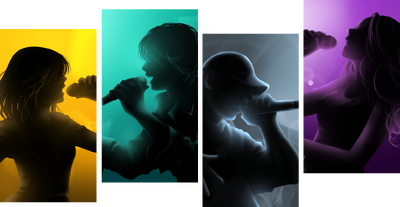

次に、Logic Proに新しいソフトウェア音源トラックを作ります。音源にはVX-βプラグイン(AU)を選択。すると、VX-βのコントロール画面が表示されます。

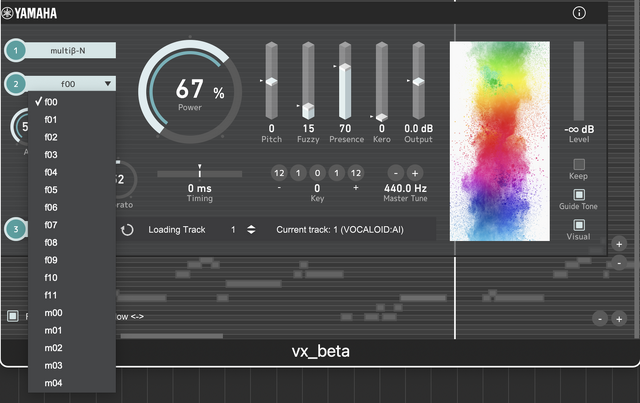

▲VXβプラグインのコントロール画面

上部にさまざまなパラメータを操作できるノブやスライダーがあり、下部に、読み込んだ歌唱データがビジュアライズされて遷移していきます。Cubase版と違い、画面サイズを大きくできないのはバグでしょうか。

数字が1、2、3と打たれている部分があります。1が、AIシンガーの名前、2が、そのシンガーの歌い方、そして3は、歌唱シーケンスファイルをインポートするためのボタンです。ここにVOCALOID6 Editorで作成したボーカルデータを読み込みます。インポートする位置とかは調整できないみたいなので、Logic Proのマスタートラックと同じBPM、スタート位置で作っておく必要があります。

今回は、ユーミンの「いちご白書をもう一度」を使用。

実はVOCALOID6のレビューでの使い回しです。

昨年10月20日のこの記事の時点で、VOCALOID6はAIボイチェンの機能を入れ込んでいて、その先見性は素晴らしいものがありました。その後、筆者はDiff-SVC、RVCといった生成AIの技術を用いて妻の歌声を再現する試みをするのですが、その先進例はすでにVOCALOIDがやっていたのでした。

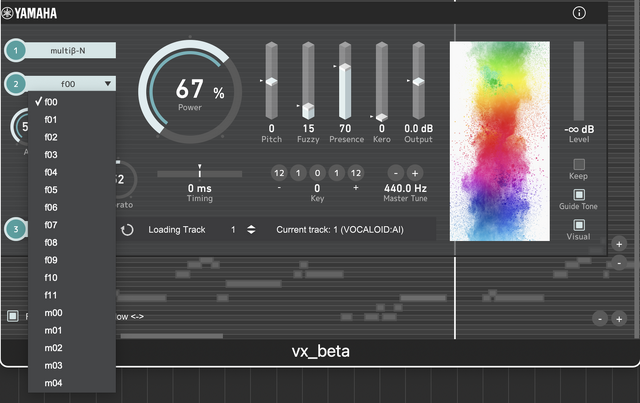

さて、当初、VOCALOID β-STUDIOには9人のAIシンガーがいると説明されていたのですが、開けてびっくり。その中の一人であるmultiβ-Nは、歌唱スタイルが17人分用意されていて、それを選ぶと全く違う歌手になります。つまり、実質的に合計25人分の歌手が選べるというわけです。おかげでこちらは記事タイトルを9人から25人に変更することになってしまいました。

▲歌唱スタイルのところに17人のシンガーが隠れていた

他の歌唱合成ソフトでも一部のシンガーを無料提供しているところはありますが、これは相当攻めに入ってきていると言わざるを得ません。

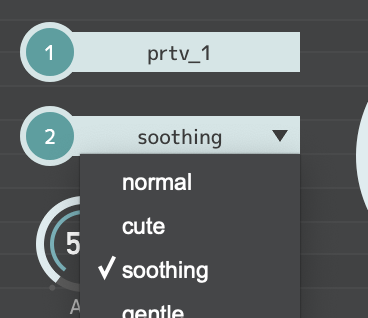

とりあえず、どれか一つに絞らないといけないので、曲に合わせてしっとりした歌い方ができそうなprtv_1を選びました。「ときに優しく、ときにキュートに心と体を包み込む魅惑の女性ストリートシンガーボイス」だそうです。名称未設定。Macの新規ファイル名みたいですが、素敵な声なので、いつか名前がつくといいですね。

▲prtv_1。名前も絵もまだない

このprtv_1の中から、さらに「soothing」という癒し系の歌唱スタイルを選んでみました。

▲歌唱スタイルを選べる

パラメータはこれまでのVOCALOIDとはだいぶ違います。吐息成分の強弱をつけるBREATHがなくて代わりにAir。Formant、Attach、Vibrato。この辺は名前で想像がつきます。

▲従来のVOCALOIDのパラメータとは大きく異なる

今回の作例では使いませんでしたが、Timingというパラメータが面白いです。FlexPitchではタイミングを調整するときにノートを左右に動かすのですが、Cubase以外ではノートを直接いじることはできません。ですが、Timingをオートメーションで上下させれば、その付近のタイミングを速めたり遅くしたりできるので、ボーカルエディターのタイミング調整の代替になります。

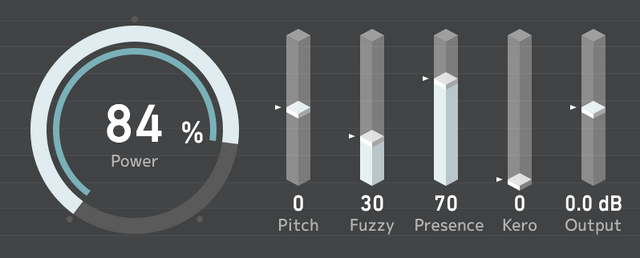

あと面白いのは、FuzzyとKero。これはそれぞれ、ピッチを不安定にする、極端に安定させる(ロボ声、ケロケロボイスにする)もので、Fuzzyパラメータを上げると、ピッチがランダムに不安定になって人間っぽくなります。大昔の家電が売りにしていた「ファジー」のイメージですね。

ですが、これらのどれも、Powerの前にはひれ伏するでしょう。VOCALOID β-STUDIO最大の発明と言っていいかもしれません。

これまで、静かなところ、盛り上がるところをVOCALOIDやその他の歌声合成でパラメータ調整するときにはいつも苦労していました。音量、トーン、吐息成分、ピッチのしゃくり、オーバーシュート、ビブラート。これらをうまい具合に組み合わせて自然な歌声にしようとしていましたが、なかなかうまくいきません。

こうした表現に関しては表現の上手い歌手には敵いません。いくつものパラメータを同時に調整すれば可能かもしれませんが、それには多大な労力とノウハウが必要。以前のバージョンではこうした表現技法を数多くのフレーズ集やマクロで実現しようとしていましたが、使いどころが非常に難しかった記憶があります。だからこそ、VOCALOID6のAIボイチェン機能が有効だったのです。

それを、一つのパラメータで表現可能にしたのがPowerです。落ち着いてしっとりさせたいところ、激しく盛り上がるところ、ふっと力を抜くところ、これらを一個のノブ、オートメーションで調整できるのです。

次の作例ではPowerパラメータの変化だけを使っています。

Logic Proのトラックに一つのオートメーションを描いただけ(上部の折れ線がそう)。これで音量も、歌い方も大きく変化します。かなり自然な盛り上がり方ができるようになりました。

ボーカリストに、「Aメロは抑えめで、Bメロは少しだけ強め。サビでは8割くらいのパワーで。最後は力抜く感じで」みたいなディレクションを、数値でできるというわけです。

ここはピッチカーブをいじりたい、しゃくらせたい、オーバーシュートを弱めに、というのが出てきたら、オーディオにバウンスしてFlexPitchの補正機能で変更すればいいのです。

VOCALOID β-STUDIOはVOCALOID:AIの進化系?

2020年暮れに「AI美空ひばり」で話題を呼んだ、美空ひばりの歌声をディープラーニングで再現するVOCALOID:AIでは、彼女の歌唱手法をどのように再現していくかが課題でした。声質だけならなんとかなりますが、問題は歌い方です。どの部分でどのように歌うかというのは歌手のそのときの気分次第で、必ずしも統計的に解が得られるというものではありません。しかも美空ひばりは不世出の天才歌手です。

であればそこにはディレクションが必要で、それをわかりやすく織り込んでいくにはどうしたらいいか、考え抜いたことでしょう。このPowerは、そうした試行錯誤を経た上での一つの解決策なのではないかと考えています。VOCALOID β-STUDIOプロジェクトのキャプテンが、この開発に携わった才野慶二郎さんなのは、そういう流れがあったのではないかと想像しています。

VOCALOID β-STUDIO、まだまだ試すことはたくさんあります。歌唱方法もAIシンガーによってだいぶ違うのがわかってきました。スタジオシンガーの場合には歌い方、ピッチが安定しているのに対し、ストリート系、ロック系はすぐにオーバーシュートしてしまうとか、クセ強めであるといったことも。

Synthesizer V、CeVIOといったAI歌声合成の新潮流に対抗するだけでなく、そのファイルを読み込めるようにするとか、異様なまでのフットワークの軽さ。Stable Diffusionが公開されてちょうど1年のこのタイミングで登場したこのプロジェクト、まだいろいろ仕掛けてきそうで、わくわくしています。

追記(8月25日20時)

という投稿がXにありました。これの意味するところは、VOCALOID β-STUDIOには追加ボイスバンクの登録が可能であり、そのボイス制作には、従来のVOCALOIDのように特殊な呪文(スクリプト)を読み上げることが不要で、一定分量のボーカルデータ(この場合はアルバム1枚分)で本人そっくりのAIシンガーを作り出せるということを意味します。

ゲキヤクβ、カゼヒキβといったUTAU由来の音源も、そこからどのようにコンバートしたのかが気になるところ。Diff-SVCやRVCと同様の学習量でということならば、数十分の歌唱データがあれば十分ということになるので、それも理解できます。

収録・制作コストがかかりすぎるというところがVOCALOIDの弱点でもあったので、この新しいスキームでどのように変わっていくのか、楽しみです。