OpenAIは11月6日(米時間)、同社初となる開発者会議「DevDay」にて、生成AIの新モデル「GPT-4 Turbo」を発表しました。

GPT-4では従来、2021年9月までのデータでトレーニングされており、最近の出来事に関してはインターネットから検索してくることしかできませんでしたが、改良版となるGPT-4 Turboは、2023年4月までのデータに対応しています。

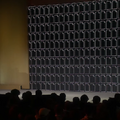

また、コンテキストウィンドウと呼ばれる一度に処理できるテキスト量が、12万8000トークンに拡大。1つのプロンプトに300 ページ以上のテキストを収めることができます。

加えて、パフォーマンスを最適化したことで、GPT-4 Turboの入力トークンあたりの価格は、GPT-4と比較して3分の1となる0.01ドルと安価になります。

Function calling(関数呼び出し)も更新され、これまでは複数の操作が必要だった「車の窓を開けてエアコンをオフにする」というような内容を1つのメッセージとして送信可能になります。常にXMLで応答するなどの特定形式の生成精度が向上したほか、あらたにJSONモードもサポートされます。

そして、GPT-4 Turboとは別に、画像入力に特化したGPT-4 Turbo with Visionも発表されました。画像を渡すと、それを読み取ってキャプションの生成や画像の詳細分析、図のある文章の読み取りなどのユースケースを可能とします。利用価格は画像のサイズにより異なり、1080×1080ピクセルの画像で0.00765ドルかかります。画像生成AIのDELL-E 3も利用可能になります。価格は生成される画像あたり0.04ドル。

すべての有料開発者は、APIで「gpt-4-1106-preview」と呼び出すことでGPT-4 Turboを利用することが可能。安定版は今後数週間以内にリリース予定としています。