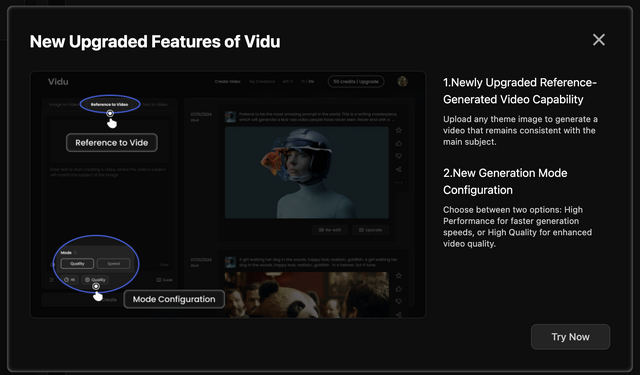

中国産の動画生成AI「Vidu」に、Reference to Videoという新機能が加わりました。AI動画生成でObject Consistency、つまり対象物の一貫性を保つことが可能になったのです。

動画生成AIサービス四天王のRunway Gen-3 Alpha、Luma Dream Machine、KLING、そしてViduはいずれもImage to Videoが可能です。

つまり、動画の始点または終点となる画像をLoRAやDreamBoothなどのファインチューニングで一貫性を持たせていれば、キャラクターの一貫性を保つことは可能です。

しかし、比較的学習が容易なLoRAでも10枚程度の同一キャラクターの画像は必要で、元画像が1枚しかない場合には、できないわけではありませんが、いろいろと工夫が必要です。

これが、ViduのReference to Videoの場合は、レファレンス、つまり参考にするキャラクターを含む画像が1枚あれば大丈夫。

■1枚の写真から動く坂本龍馬

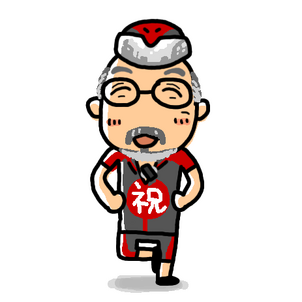

例えば、唯一残っているとされる坂本龍馬の写真をPhotoshopでカラー化した画像をレファンレンスにして動画生成してみましょう。

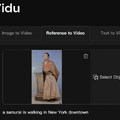

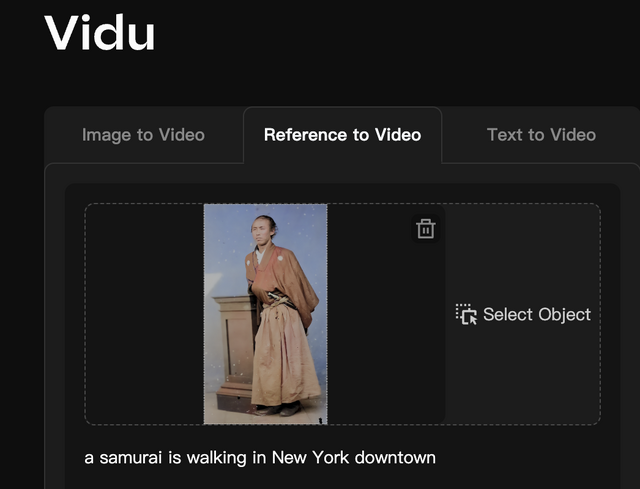

▲Photoshopでカラー化した坂本龍馬の写真

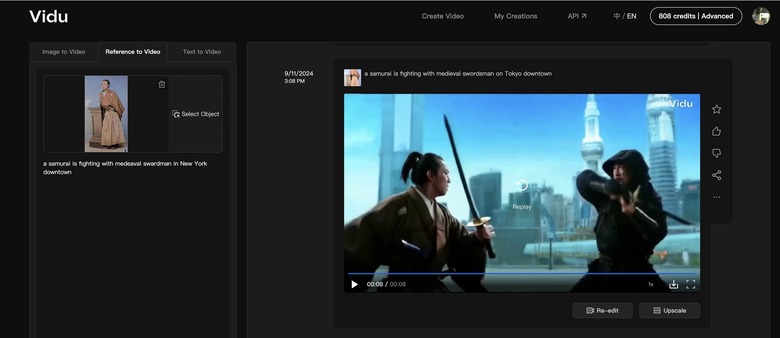

ViduのReference to Videoタブでこの画像を読み込んでオブジェクトとして指定し、プロンプトを書きます。今回は「ニューヨークのダウンタウンを侍が歩いている」。

▲坂本龍馬の写真をレファレンスにしてプロンプトで動画生成

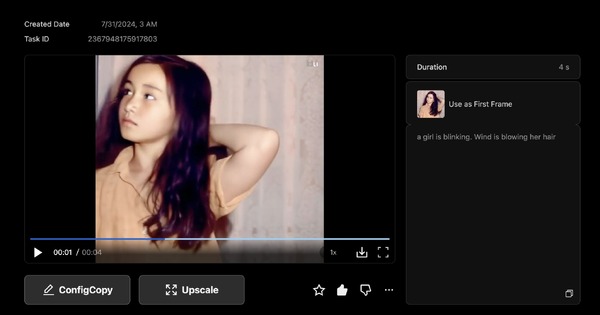

ニューヨークを坂本龍馬がかなり自然な感じで歩いています。

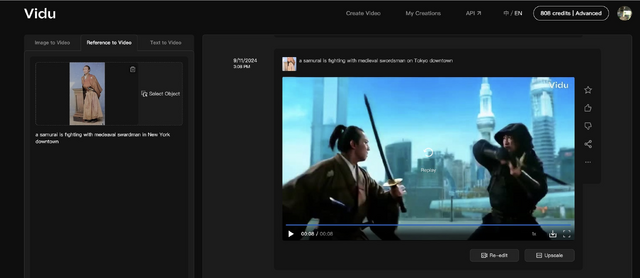

戦闘シーンも、同じレファレンス画像のままでできました。

▲ニューヨークで戦う坂本龍馬

■動物も動きます

動物もOK。20歳まで生きた、我が家の最後のネコ「めそ」が池のそばを歩いています。彼は家猫だったので、一度も外に出ることはなかったのです。

特定の時期の姿での動画生成も簡単です。LoRAだと中間的な顔になるので、それよりも個性が出やすいと思います。

従来は、一貫したキャラクターを出したい場合にはLoRAを多用するしかなかったのですが、この機能を使えば、ストーリー性のある動画を作るためのハードルがかなり下がります。

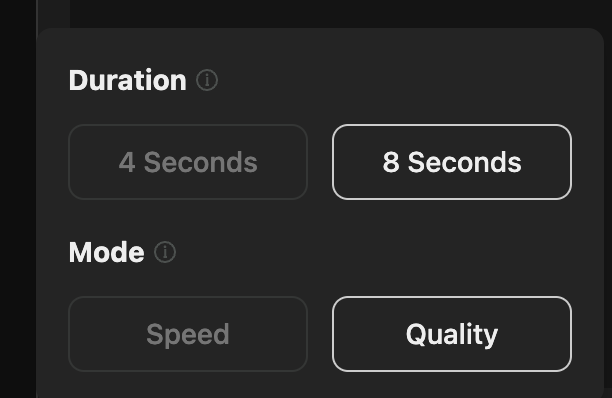

従来と同じく長さは4秒と8秒から選択。品質は速度優先と品質優先を選べます。

8秒 + 品質優先にすると16クレジットが飛んでいき、さらにウォーターマークを外すのに追加で8クレジット必要と、なかなか金食い虫ではありますが、超便利です。