OpenAIのサム・アルトマンCEOがXで、新たなモデルの展開について投稿しました。次期モデルとして「GPT-4.5」(社内開発名Orion)をリリースすることに加え、ChatGPTとAPIの両方で「GPT-5」を提供する計画を発表。特筆すべきは、GPT-5が無料ユーザーにも無制限で利用可能となる点です。

OpanAIが画像を白黒ドット画像に変換する「Ad Creator」を公開しました。o3-miniを用い、次のプロンプトで作ったそうです。「Make a app called chatgpt ad maker that takes in a image and does a black and white dotted image effect with sliders to adjust dot size」

Perplexityが数十回の検索を行い、何百もの情報源を読み込み、それらの内容について論理的に考察し、包括的なレポートを自動的に作成するAI機能「Deep Research」をリリースしました。「人類最後の試験」において、Deep Researchは21.1%の正解率を達成し、OpenAIのdeep researchの26.6%に及びませんが、Gemini Thinking、o3-mini、o1、DeepSeek-R1、その他の主要モデルを大きく上回りました。制限はありますが、無料ユーザーでも使用できます。

さて、この1週間の気になる生成AI技術・研究をいくつかピックアップして解説する「生成AIウィークリー」(第83回)では、大規模言語モデル(LLM)を画像操作できるAIエージェントに変換する「OmniParser V2」や、ByteDanceの画像や動画を生成する新しいAI「Goku」を取り上げます。

また、Microsoftが開発のデータを可視化するAIシステム「Data Formulator 2」がGPTやClaudeに対応した内容や、Claudeが膨大な内部データを使用してAIが労働市場に与える影響を調査した研究論文をご紹介します。

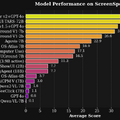

そして、生成AIウィークリーの中でも特に興味深いAI技術や研究にスポットライトを当てる「生成AIクローズアップ」では、OpanAI「o3」が国際情報オリンピック(IOI)で金メダルを達成した研究報告を単体記事で掘り下げています。

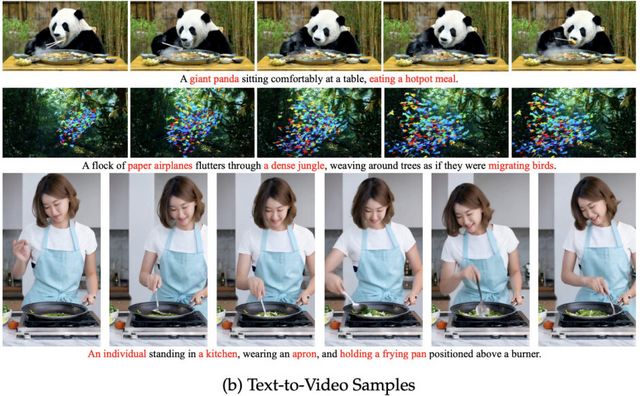

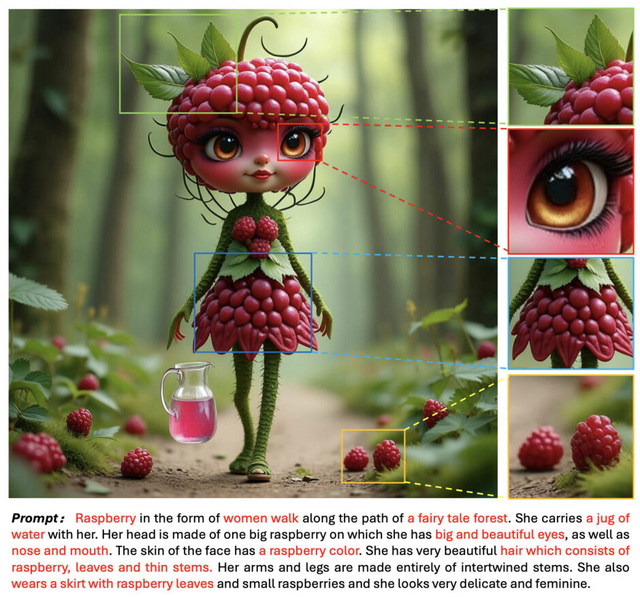

ByteDanceが新しい動画生成AI「Goku」と広告特化版「Goku+」を発表

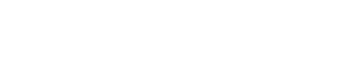

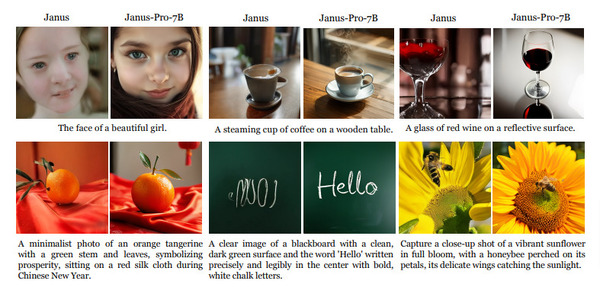

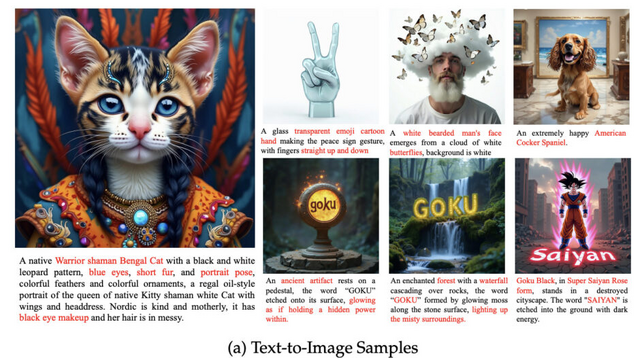

画像と動画を同時に生成できる新しいAIモデル「Goku」とその広告特化版「Goku+」が香港大学とByteDanceの研究チームによって発表されました。これらのモデルは、高品質なデータセット、効率的なモデル設計、そして最適化されたトレーニングインフラを組み合わせることで、産業レベルの性能を実現しています。

Gokuは約3600万の動画と1億6000万の画像からなる大規模なデータセットを活用し、2Bおよび8Bパラメータを持つTransformerアーキテクチャを採用しています。特徴的なのは、画像と動画の入力を共有空間で処理できる3D結合変分オートエンコーダーを採用している点です。また、審美的なスコアに基づく動画・画像のフィルタリングやOCRを用いたコンテンツ分析、主観的評価など、複数の先進的な技術を組み合わせてデータの質を高めています。

評価実験では、複数のベンチマークテストで優れた性能を示し、特に動画生成タスクではVBenchで84.85という高スコアを記録し、既存の商用モデルを上回る結果を達成しました。画像生成においても、GenEvalで0.76、DPG-Benchで83.65という高いスコアを記録しています。

広告制作に特化したGoku+では、人物と商品の相互作用を最適化し、広告シナリオに特化した機能が追加されています。20秒以上の長尺動画を生成でき、人物の手の動き、表情、体の動きを安定的かつ表現力豊かに生成することが可能です。また、商品画像を魅力的な動画クリップに変換する機能も備えており、広告制作のコストを従来の100分の1に削減できることが示されています。

Goku: Flow Based Video Generative Foundation Models

Shoufa Chen, Chongjian Ge, Yuqi Zhang, Yida Zhang, Fengda Zhu, Hao Yang, Hongxiang Hao, Hui Wu, Zhichao Lai, Yifei Hu, Ting-Che Lin, Shilong Zhang, Fu Li, Chuan Li, Xing Wang, Yanghua Peng, Peize Sun, Ping Luo, Yi Jiang, Zehuan Yuan, Bingyue Peng, Xiaobing Liu

Project | Paper | GitHub

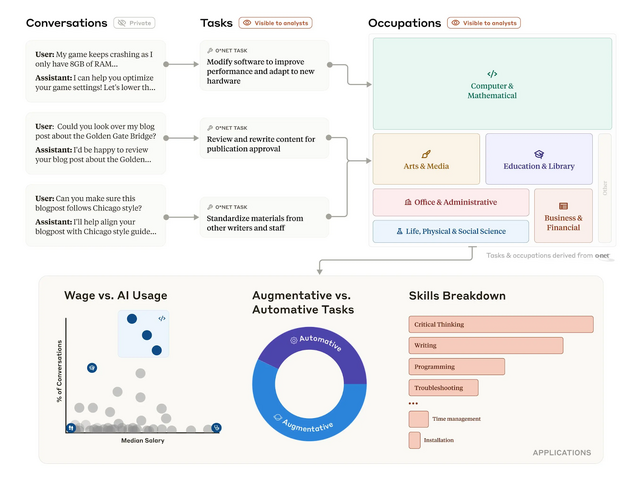

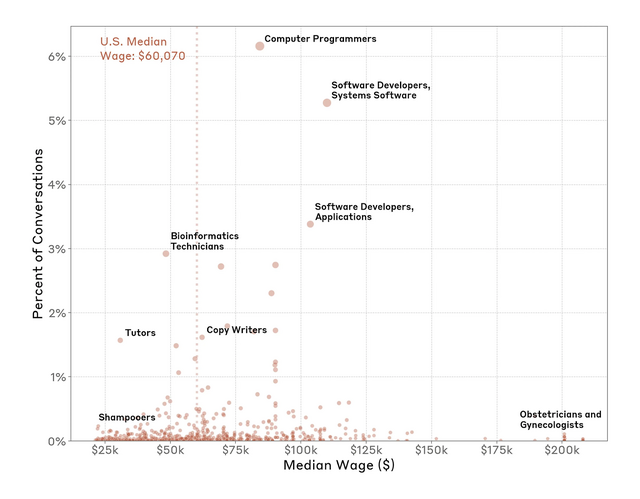

AIが労働市場に与える影響をAnthropicが調査。Claudeでの数百万件のやり取りしたデータを分析

Anthropicは、AIが労働市場に与える影響を理解するため、「Anthropic Economic Index」を立ち上げました。このレポートでは、Claude.aiでの数百万件の匿名化されたやり取りしたデータを分析し、現代経済におけるAIの実践的な活用状況を明らかにしています。

主な調査結果によると、現在のAI利用は主にソフトウェア開発と技術文書作成に集中しており、全職種の約36%で関連タスクの4分の1以上でAIが使用されています。一方、タスクの4分の3以上でAIを使用している職種は約4%にとどまっています。

AIの活用方法については、人間の能力を補完・強化する「拡張」が57%、AIが直接タスクを実行する「自動化」が43%となっています。また、コンピュータプログラマーやデータサイエンティストなど、中~高賃金の職種でAI利用が目立つ一方、最低賃金層と最高賃金層での利用は比較的少ないことが分かりました。

職種別では、ソフトウェアエンジニアリング関連の「コンピュータと数学」カテゴリーが全体の37.2%と最も多く、次いで「芸術・デザイン・スポーツ・エンターテインメント・メディア」が10.3%となっています。後者は主に文章の作成や編集での利用が中心です。一方、「農業・漁業・林業」などの肉体労働が中心の職種では、AIの利用は0.1%と極めて限定的でした。

Which Economic Tasks are Performed with AI? Evidence from Millions of Claude Conversations

Kunal Handa∗ , Alex Tamkin∗ , Miles McCain, Saffron Huang, Esin Durmus Sarah Heck, Jared Mueller, Jerry Hong, Stuart Ritchie, Tim Belonax, Kevin K. Troy Dario Amodei, Jared Kaplan, Jack Clark, Deep Ganguli

Paper | Blog

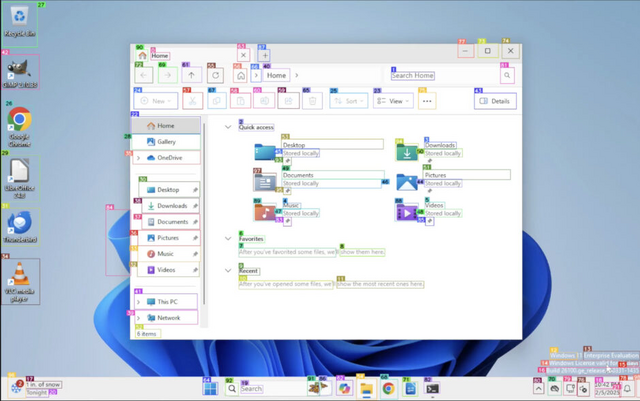

LLMを画面操作のAIエージェントに変換するシステム「OmniParser V2」をMicrosoftが開発

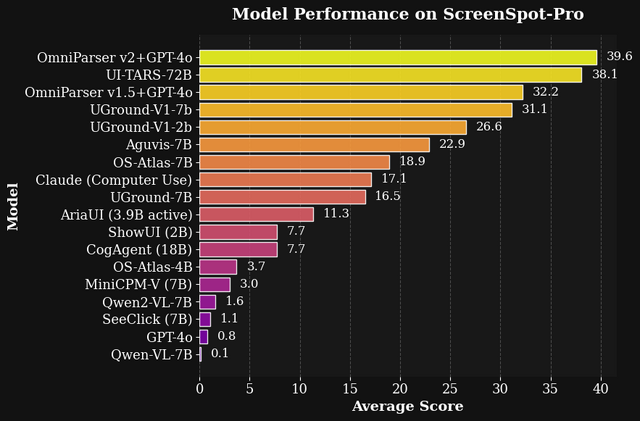

Microsoft Researchは、大規模言語モデル(LLM)を汎用的なコンピュータ操作エージェントに変換する「OmniParser V2」を発表しました。これは、グラフィカルユーザーインタフェース(GUI )の自動化において、画面上のアイコンやボタンなどの操作可能な要素を正確に認識し、それらと適切なアクションを結びつける機能を持つツールです。

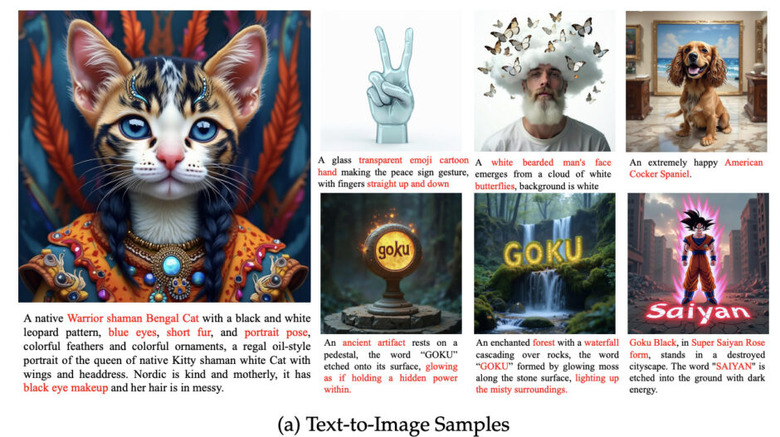

従来版と比較して、OmniParser V2は小さな操作可能要素の検出精度が向上し、処理速度も60%向上しています。特筆すべき点として、GPT-4oと組み合わせた場合、高解像度の画面や小さなターゲットアイコンを含むベンチマーク「ScreenSpot Pro」において、平均精度39.6%を達成しました。これは、GPT-4o単体の精度0.8%から大幅な改善となっています。

また、マイクロソフトは様々なエージェント設定での実験を容易にするため、「OmniTool」というDockerベースのWindowsシステムも公開しています。このツールを使用することで、OpenAI(4o/o1/o3-mini)、DeepSeek(R1)、Qwen(2.5VL)、Anthropic(Sonnet)など、最先端のLLMモデルとOmniParserを組み合わせた画面理解、アクション計画、実行が可能となります。

OmniParser V2: Turning Any LLM into a Computer Use Agent

Microsoft

Project | GitHub | Blog | Hugging Face

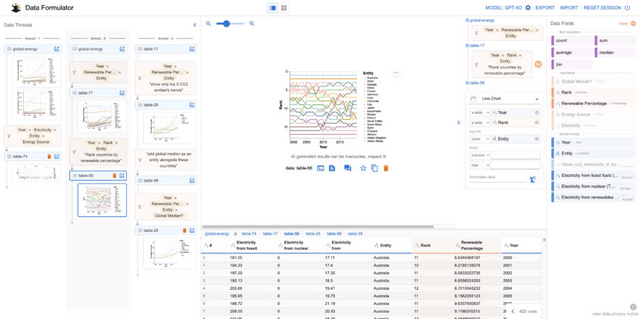

Microsoftが開発のデータを可視化するAIシステム「Data Formulator 2」がGPTやClaudeに対応

「Data Formulator 2」は、データの可視化作業をAIの支援のもとでより効率的に行えるようにするシステムについての研究です。

データアナリストは通常、可視化作業において何度も試行錯誤を繰り返しながら目的の表現に到達します。このプロセスでは、データの加工と可視化の設定を何度も行き来する必要があり、さらに異なるバージョンのデータや図表を管理する必要もあります。

これまでにもAIを活用した可視化ツールは開発されてきましたが、それらは主に自然言語による一回限りの指示で完結することを想定しており、試行錯誤を伴う作業には適していませんでした。

Data Formulator 2では、GUIによる直感的な操作と自然言語による柔軟な指示を組み合わせることで、複雑な可視化作業をサポートします。また、過去の作業履歴を効率的に管理し、以前の成果を新しい可視化作業に活用することができます。

2025年2月12日のアップデートにより、システムの機能が大幅に拡張され、OpenAI、Azure、Ollama、Anthropicなど、より多くのAIモデルをサポートするようになりました。特にGPT-4oやClaude 3.5 Sonnetなど、コード生成と指示への対応能力が高いモデルの使用が推奨されています。

Data Formulator 2: Iteratively Creating Rich Visualizations with AI

Chenglong Wang, Bongshin Lee, Steven Drucker, Dan Marshall, Jianfeng Gao

Paper | GitHub