最近、AIで曲を作りました。そのワークフローが結果的に、いろいろなAIツールを少しずつ使っていく、ちょっと面白いものになったので、その流れを紹介しつつ、最近のAIツールの進化についても触れていければと思います。

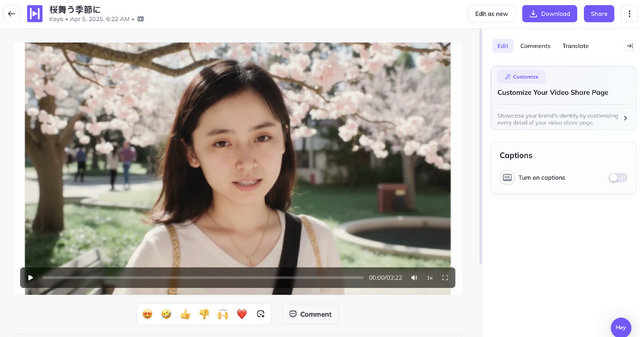

まず、完成したミュージックビデオを紹介しましょう。ここで使った動画の一部については、別記事で解説しています。

音楽パートの大まかな流れとしては、曲のモチーフ→曲の断片→歌詞制作→曲の完成→ボーカルの置き換え→メロディーの変更→コード譜取得→ピアノパートの追加→コーラスパートの追加→マスタリング、となります。

では、このワークフローを振り返っていきます。

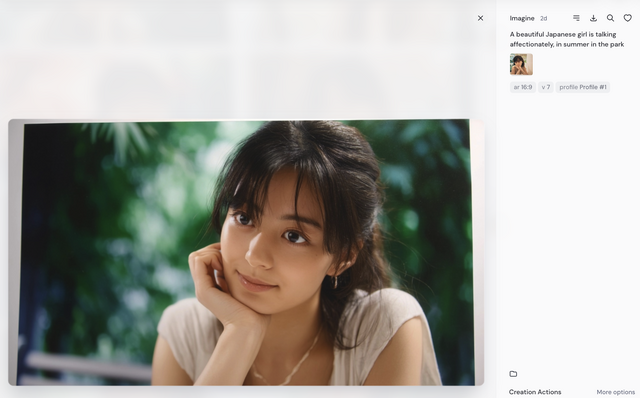

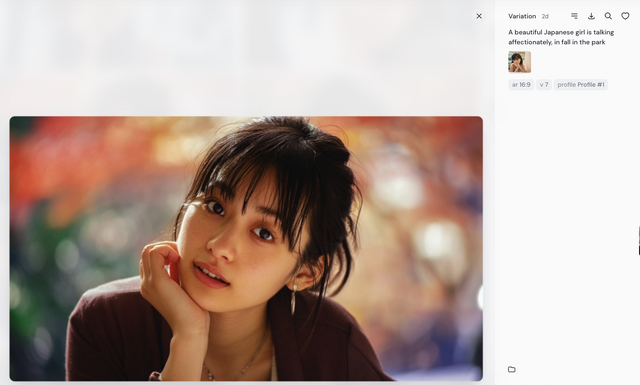

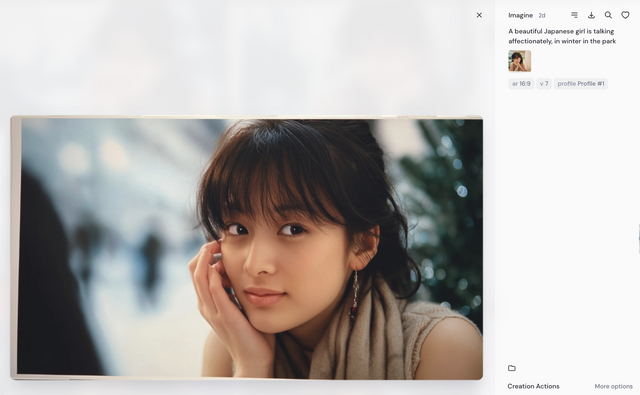

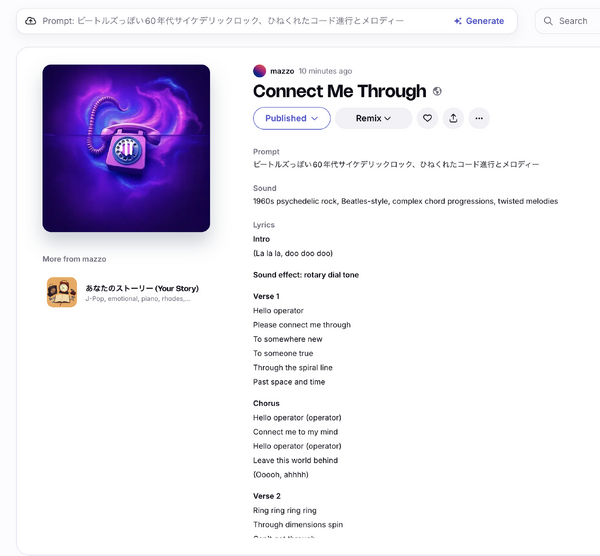

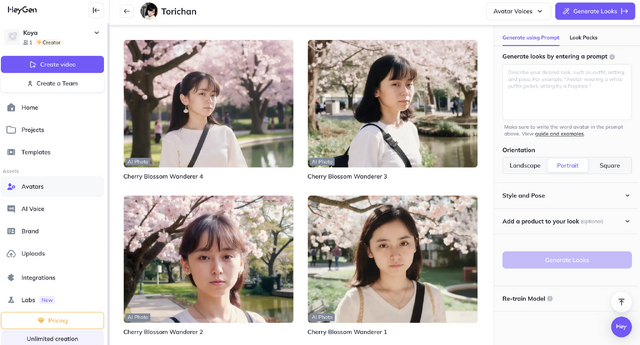

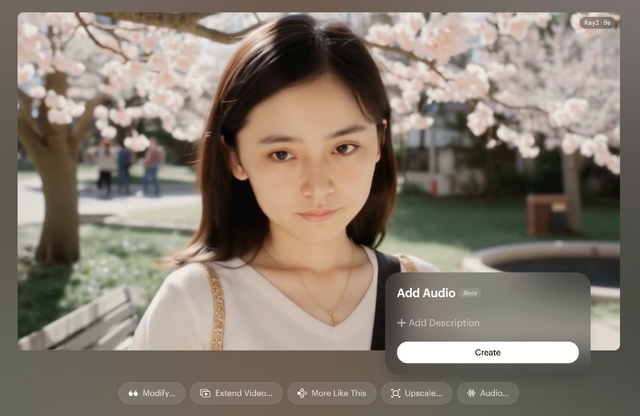

曲のモチーフ:HeyGenのPhoto Avatarで桜の季節の画像を生成

曲のモチーフは、桜が咲いている中にいる妻のイメージ。妻のAI画像生成は、最初はDream BoothでファインチューニングしたStable Diffusionを2022年秋にスタートし、それからFLUX.1 [dev]のLoRAへと主流が変わってきましたが、最近ではHeyGenを使うことが多くなっています。FLUX.1用LoRAとほぼ同じ写真のセットを使っているのですが、HeyGenの方が本人再現度が高いからです。

HeyGenにはPhotoAvatarという機能があり、20枚ほどの人物写真を学習させると、本人のリアルイメージにかなり近い画像をプロンプトで生成できるようになります。さらに、本人の声を学習したTTS(Text to Speech)や入力したボーカルデータに合わせてリップシンクをさせることも可能。その長さも数分間まで可能なので、歌うだけのミュージックビデオならこれだけでも可能という優れものです。

ただ、ここでは「Avatar is under cherry blossom」というシンプルなプロンプトで4枚ほどの画像を生成。これがこの曲のモチーフとなりました。

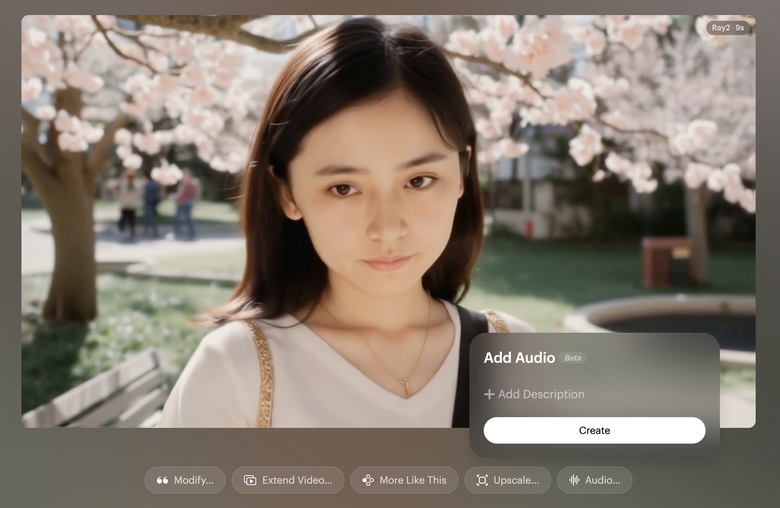

画像から生成した動画にAIで音をつける:Luma Dream MachineでAdd Audio

HeyGenで生成した画像のうち、お気に入りの1つからKLINGで動画を生成。そこから取り出した2フレームを使ってLuma Dream Machineで動きをつけてみました。そして、Lumaには動きに音を追加する機能も装備されていたので、そちらもお試し。

動画にサウンドを付ける機能は、ElevenLabs、MMAudioが単独のサービス、オープンソースソフトウェアとして公開されていますが、Lumaは生成した動画にその場でサウンドを追加できるというもの。同様の機能はKLINGにもついています。

ここでLumaが勝手につけた曲のようなものは当然、日本語ではなく、おそらくどこの国の言葉でもない、テープの逆回転ようなボーカルですが、どことなく本人の声を感じさせるようなものでした。

これをモチーフに曲ができるのではないかと考えたのです。

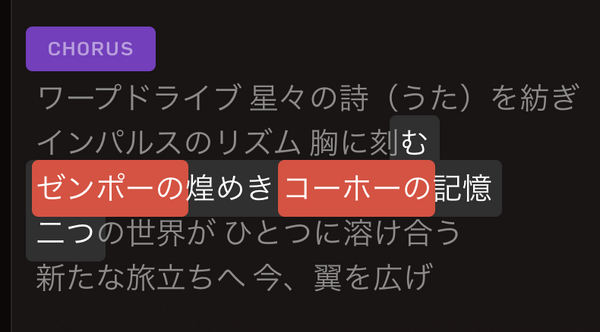

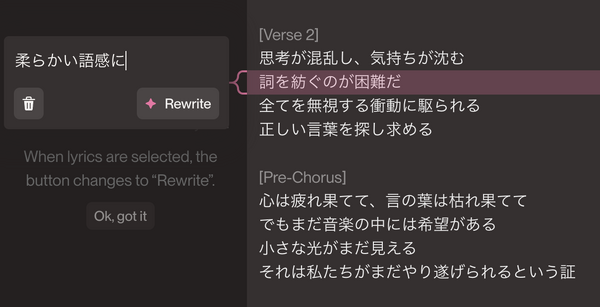

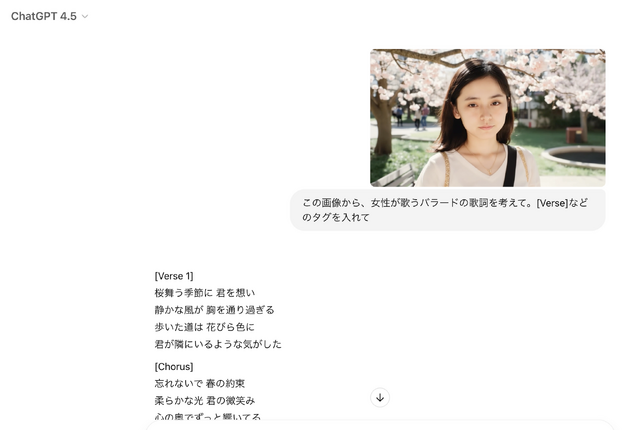

画像を読み込ませて作詞;ChatGPT 4.5が紡ぐ言葉

まず、歌詞を作りたい。今回は、ChatGPT 4.5に考えてもらいました。画像を読み込んで、そこからイメージする歌詞を推論してもらいます。

女性が歌う曲なので、君ではなく、あなたに変更させ、歌詞ができました。なかなか良い歌詞だと思います。

[Verse 1]

桜舞う季節に あなたを想い

静かな風が 胸を通り過ぎる

歩いた道は 花びら色に

あなたが隣にいるような気がした[Chorus]

忘れないで 春の約束

柔らかな光 あなたの微笑み

心の奥でずっと響いてる

あなたがいた あの季節のままで[Verse 2]

淡い記憶の 中に佇む

静かな瞳に 何を映したの

咲いて散るのが運命だとしても

この想いだけは 色褪せないよ[Chorus]

忘れないで 春の約束

花びらに託した あなたへの言葉

ひとり歩く道の片隅で

何度もあなたを 探してしまう[Bridge]

あなたと見た あの日の景色

心の中で今も鮮やかに

もう一度だけ 出逢えるならば

伝えたい この胸のすべてを[Chorus]

忘れないよ 春のぬくもり

儚いけど美しい 桜のように

季節が巡り巡ってもずっと

あなただけが 私の春だから[Outro]

花びらひとひら 空に舞って

そっと呟く あなたに届けと

優しい風にのせて歌うよ

いつまでも あなたを想いながら

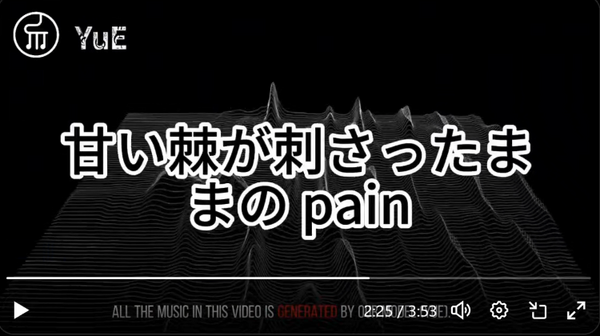

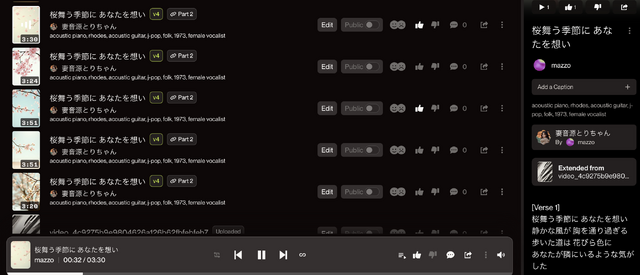

曲がいちおう完成:SunoのAudio InputでAIが勝手につけた曲の断片を読み込ませる

Suno、Udio、Riffusion、そしてオープンソースソフトのYuEなど、最近のAI作曲ソフトは歌詞と音楽スタイルだけでなく、オーディオクリップを元に曲を作ることが可能になっています。

今回は、Sunoでその機能を使ってみました。

Lumaが動画につけたオーディオを抜き出し、Sunoの「Add Audio」機能で取り込みます。

そのクリップの続きをSunoのExtend機能で作らせ、3回目の試行でいい曲ができたので、それに決めました。

Sunoには歌声と音楽スタイルを固定するアバターという機能があります。現在は封印されているのですが、妻の歌声をAdd Audioでインプットしてそれをアバターにすることが可能だったので、妻に似た歌声と音楽スタイルが、「妻音源とりちゃん」というアバターで可能になっています。

声は完全に同じではないものの、近いイメージの歌声とバラードが制作可能になっているのです。

LumaのAIサウンドとSunoの続きをまとめた曲がこちらです。これだけで完成度が高い曲です。途中に入るピアノのブロックコード8つ打ちがとても好み。

ただ、このメロディーや歌詞の発音などでいくつか気になるところがあります。その上で、妻の歌声にもっと近づけたい。続きは愛用しているDAWのLogic Proを中心とした作業になります。

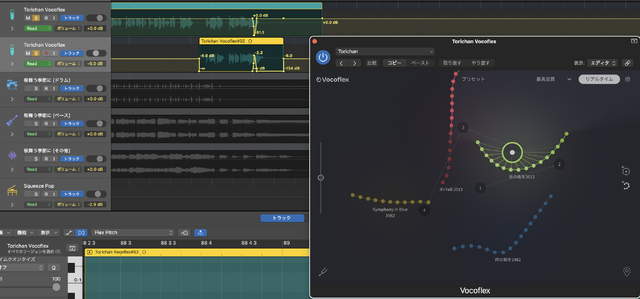

歌声をAIボイスに置き換え、ピアノとコーラスのトラックを追加

ここが自分的には一番楽しいところです。音楽を作る行為を妻の歌声と一緒にできること、それを妻が18歳の時から始め、50歳で他界した後もUTAU-Synth、Diff-SVC、RVC、Vocoflexといった様々なツールのおかげで、12年近く音楽制作を共にできる環境が得られています。

ただ、演奏のすべてのパートを自分でプレイするのはなかなかしんどく、完成度も低いのが気になります。そこをAIがだいたいのところをやってくれるようになり、「おいしい部分」だけを自分にやらせてもらえるようになったのです。

さて、SunoはSTEM出力ができますが、できるのはボーカルとそれ以外の分離だけ。これでは不十分なので、全パート入りのWAVファイルをいったんLogic Proに取り込み、STEM Splitterという機能で、ボーカル、ベース、ドラム、その他の4パートに分離します。

ボーカルトラックが分離できたので、気になるところを修正していきます。Logic ProにはFlex Pitchという、ボーカルのピッチやタイミングなどを音符ごとに修正する機能がついているので、基本はこれを使います。現在の多くのプロミュージシャンが使っているMelodyneと基本的にあ同じ機能です。

発音のおかしいところは他のフレーズからコピペしてタイミングやピッチをFlex Pitchで変更し、どうしてもダメなところは自分で歌い直して、元ボーカルを整えます。

そしたら、それを妻の歌声に変換。

方法は2つあります。一つは、妻の歌声や話し声、UTAU-Synthで歌った歌唱データなど1時間分の音源を学習したAIモデルを使ったRVCというオープンソースソフトにLogic Proで加工したボーカルトラックを入力し、声を「ボイチェン」すること。

もう1つは、DreamtonicsのソフトであるVocoflexプラグインを使い、Logic Proのトラックの中でボイチェンすること。その歌声は、妻が実際に歌った曲のフレーズの一部を取り込んで、参照しています。

RVCとVocoflexはどちらがいいかは曲によるし、歌い手にもよります。例えば、ゴールデンストーンズという番組で、「夢想花」を円広志さんご本人の歌声のまま別の歌詞に変えてゲームのBGMに使っていますが、そこではRVCとVocoflexの2つを比較した結果、Vocoflexの方が本人の歌声に近いと判断し、そちらを使いました(音源の制作を担当しました)が、基本的なワークフローは今回も同じです。

妻の歌声の場合はRVCの方が似るのですが、一部発音が不明瞭な部分があり、そこは自分が歌い直してそこだけVocoflexを使うといったこともしています。

コーラスパートを入れるのはさらに楽しいです。好きなところに自分のボーカルを最大5パート重ねています。誰かのカバーではないから、こんなことも自由にできます。妻のAIの歌声と自分のコーラスがうまく混ざり合ったなと思えた時の一体感たるや。

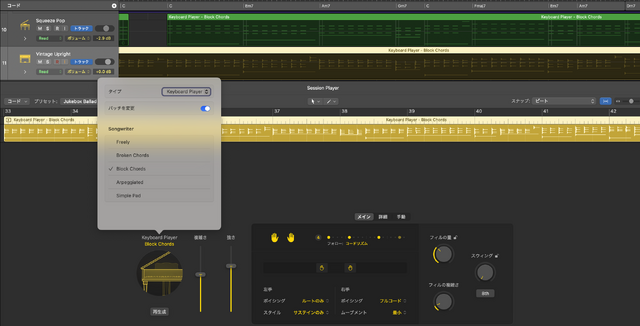

そこまではこれまでもやってきたことなのですが、今回は新しい試みを1つしています。それは、Session Players機能を使ったこと。

Session PlayersはLogic Pro 11の新機能で、これまでのドラムに加え、キーボードとベースを、指定したコード進行に合わせてプロのセッションプレイヤーのクォリティで演奏してくれるというもの。

ただ、Logic Proはコードの自動解析まではやってくれません。既存曲のカバーであれば、コード進行がネットに上がっているのでそれを参考にすればいいのですが、AIオリジナルだとそれもできない。

Melodyne Studioにはコード解析機能もありますが、もうちょっと手軽に使えるものがないものか。

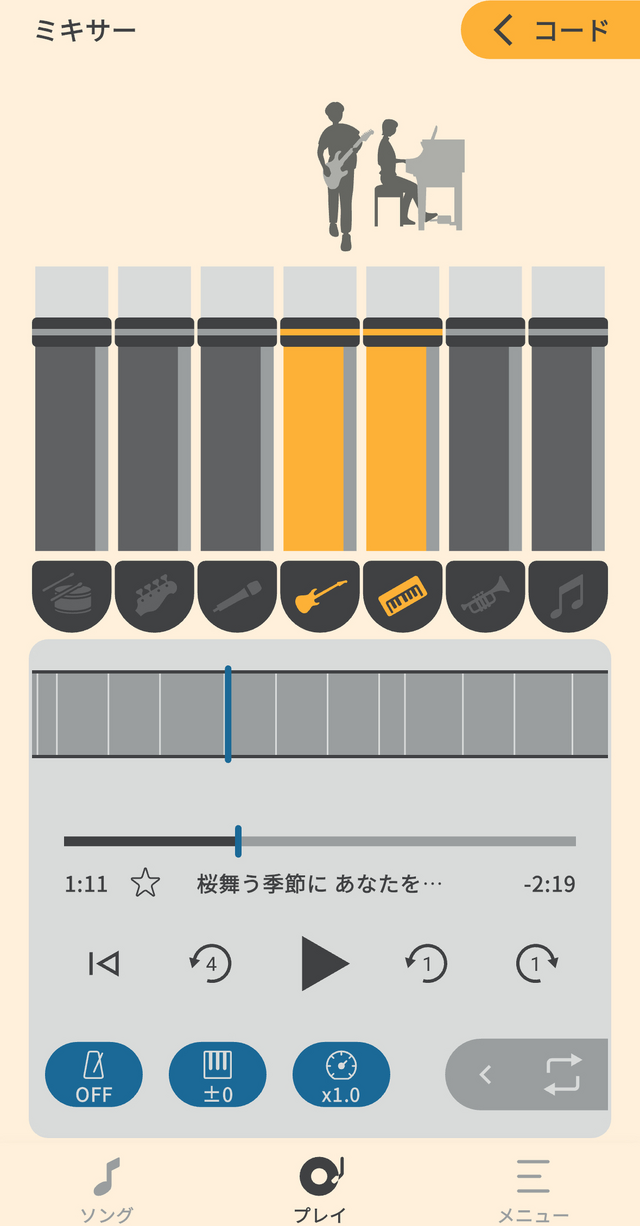

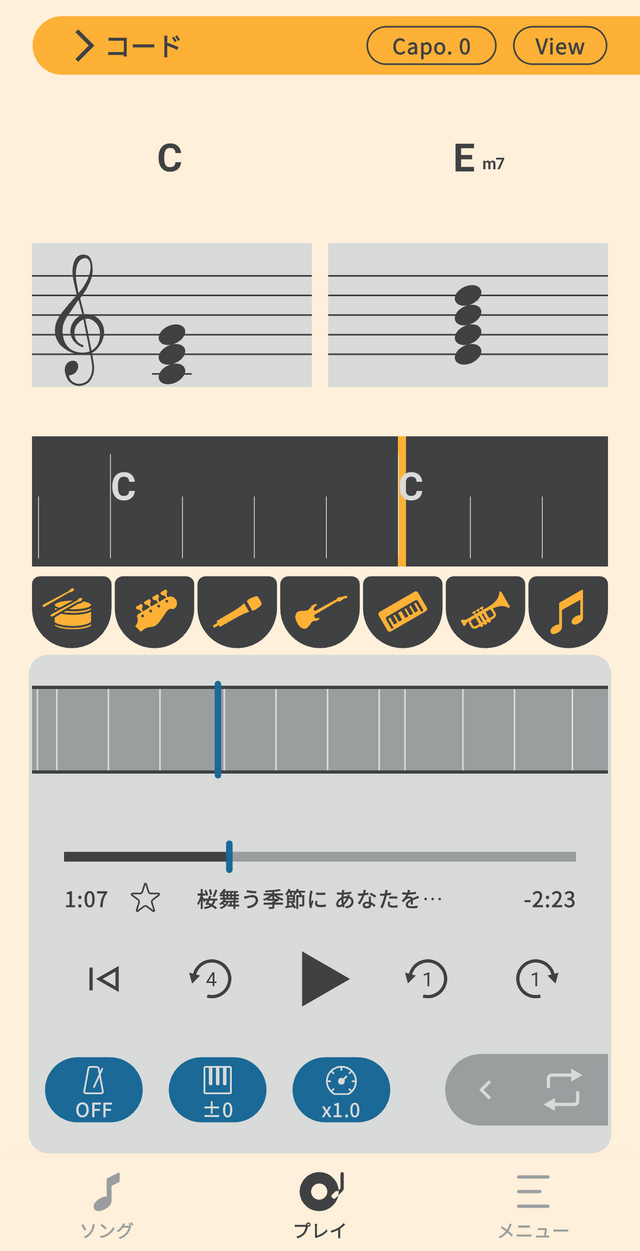

そんな時にヤマハが新しいアプリを出してくれました。「Extrack」というiPhoneアプリです。3月18日にリリースされたばかり。

基本無料ですが、月額900円でサブスクする有料プランでは、STEM分離機能がギター、ピアノ、ブラスを含む7種類をサポートするなど、他の類似ソフトと比べてもかなりお安い。

そして、コードのリアルタイム解析機能もついています。AI楽曲であっても、このアプリに取り込めば、楽曲のコード進行がわかるのです。

Extrackが採譜したコードをLogic Proに転記し、そのコード進行に合わせてブロックコード8つ打ちスタイルでピアノを重ねると、まさに目指しているサウンドになりました。

こうして、楽曲は一応の完成となりました。次は、ミュージックビデオの制作です。

ミュージックビデオ制作:HeyGenとRunwayのリップシンク

ミュージックビデオは、できれば歌詞の世界観に合わせたものにしたいもの。その歌詞に合わせた情景のプロンプトをChatGPTに書かせ、それを画像生成AIに描かせて、さらに動画生成AIで動かす。自分が作る場合には基本的にその作業の繰り返しになります。

ただ、現状のAI動画サービスだと作れるのは5秒もしくは10秒です。RunwayのEdit Video機能を使えばスピードを最大25%にすることで40秒以上の長さにすることも可能ですが、1曲分丸ごととはいきません。

今回の楽曲「桜舞う季節に」は3分30秒以上の長さがあります。

これだけの長さのリップシンクができるのはやはりHeyGen。この曲ができるものになった画像自体がHeyGenで生成したものなので、それをそのままリップシンクのベースに使います。

そこに、ボーカルトラックだけを取り出したオーディオデータを取り込み、リップシンク変換を開始。処理時間は結構かかりますが、最終的に1080p、25fpsのリップシンク動画ができます。

Final Cut Proに、オーディオデータ(完成版)とリップシンク動画を重ねて、とりあえず、ずっと歌い続ける動画はできます。

でも、これだけではおもしろくないので、場面に合わせた動画を別途追加し、置き換えていきます。

ちなみにリップシンクはHeyGenだけでなく、sync.、Hedraなどの専用サービス、動画生成サービスではRunway、KLINGなどがサポートしています。自然なリップシンクという意味ではKLINGが良いのですが、最大でも10秒という制限があるせいで、使いどころが難しいのです。

シーン別、歌詞に合わせて画像を生成し、クリップを生成:PikaframesとMidjourney V7

歌詞のすべてに桜が舞っていて、妻の写真を学習・参照していれば多少絵柄の違いがあってもいいだという内部基準のもと、シーン用の画像を生成したりピックアップしていきます。

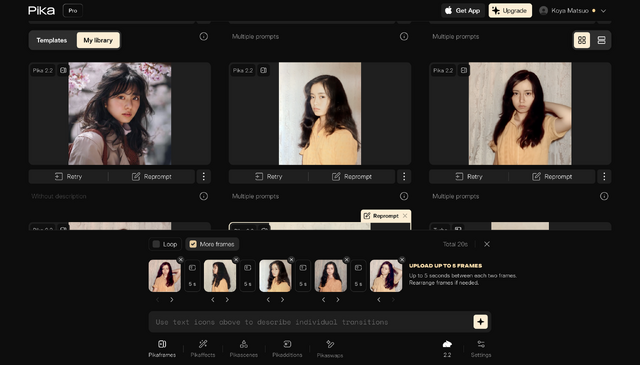

一部、黄色いシャツを着た妻の数枚の写真をPikaframesで繋げたクリップを使っています。

Pikaframesは5枚の画像をフレーム補完することで最大25秒のクリップを生成できます。その中から使える部分だけを切り出しました。長尺のクリップを生成できるというのはそれだけで正義です。Soraも、もうちょっとまともになったら活用できるんですが……。

歌詞の中にある、

季節が巡り巡ってもずっと

あなただけが 私の春だから[Outro]

花びらひとひら 空に舞って

そっと呟く あなたに届けと

優しい風にのせて歌うよ

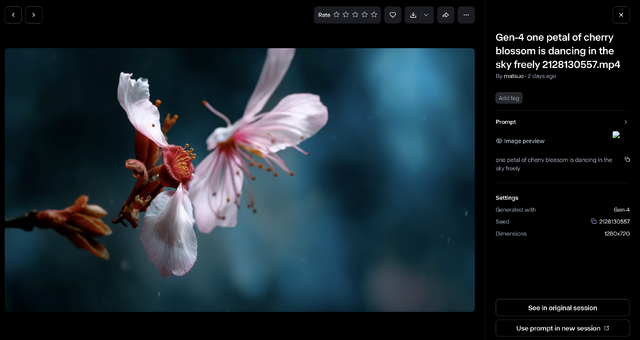

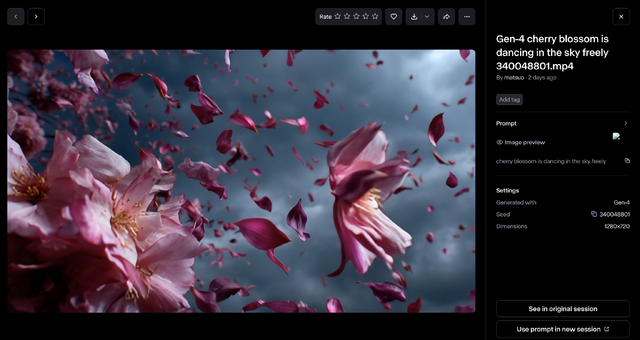

ここから「季節が巡り」「花びらひとひら 空に舞って」「優しい風にのせて」の3つは、Midjourney V7で画像を生成しました。

季節が巡るところは、妻の写真を参照してプロンプトで生成したMidjourney V7の画像をPikaframesで遷移させて作成。

花びら1枚、たくさんの花びらが舞うシーンは、動きが良いと評判のRunway Gen-4を使用しました。Runway Gen-4は人物でも髪の毛が風に靡くところなど、従来のGen-3では不自然だったところが改善されているので、積極的に使っていきたいです。

リップシンクはHeyGenだけでなくRunwayも使って、歌詞に合わせた場面を歌ったりしています。

とりあえず完成はしましたが、以前ヴァイブコーディングで作ったビジュアライザーをもっといいものにして、組み合わせてもいいかもしれません。

面白そうな新技術が出てきたらクリップを置き換えたりして、楽しみながらバージョンアップしていきたいと思います。自分が楽しむ部分は思いっきり楽しんで、あとはAIに可能性を広げてもらうというワークフローの1つのサンプル紹介でした。