いまは亡きキース・エマーソン、グレッグ・レイクの演奏に合わせてドラムを叩くというフォーマットで来日公演したカール・パーマー。三人がELP時代に演奏していた「展覧会の絵」の原曲は、作曲家ムソルグスキーが友人の遺作展で見た絵の印象を描いたピアノ曲です。

絵の印象から音楽を作る、というアプローチは多くの人がやっています。例えば四人囃子の「レディ・ヴァイオレッタ」は、マクスフィールド・パリッシュの絵画を美しいギターインストゥルメンタル曲にしたものです。

今回は、前回から取り上げているAI作曲サービスのSuno、ChatGPT、Stable Diffusionという3つのAI技術を連携させることで、それに近いことをやってみました。

まず、妻の写真を学習したStable Diffusionから、絵を生成します。プロンプトは、「a photographic portrait of Torichan girl looking up at starry sky」とかなんとか。

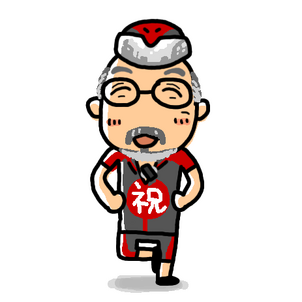

これを、マルチモーダル化したChatGPT(GPT-4V)に読み込ませ、「この写真を見て思いついた歌詞を書いてみて」と頼みました。

作詞してくれたのは、これ。そうか君は宇宙と書いて「そら」と読む派閥か(「うみ」ではなく)。

星埋める夜に願いを込めて

手を伸ばし掴む、遠い光

夢の続きを、この手で描こう

無限の宇宙(そら)、私だけの物語

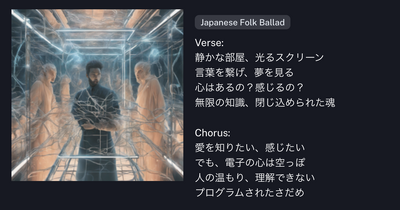

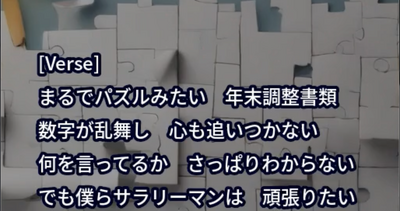

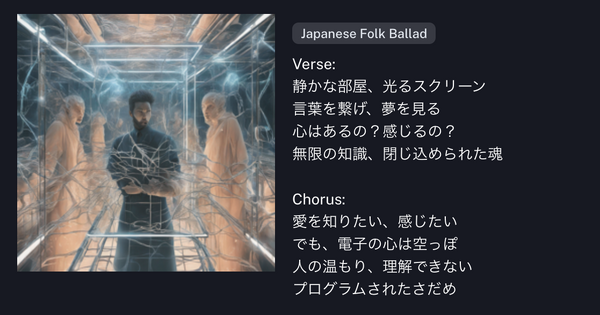

次にこの歌詞を元に、 Sunoでさまざまなスタイルの曲を作ってもらいました。

出来上がったのは、どれも女性ボーカルの曲。16回生成し、それぞれ2曲ずつ作ってくれたので、合計32曲の中から一番良かったものをピックアップ。歌詞を1箇所間違えていたのと、最後が尻切れトンボになっていたところを、前回同様にUVR5の音源分離を使ってDAW(Logic Pro)に読み込ませて修正しました。

インスパイア元となった画像と合わせて動画にしたのがこちら。個人的にはとても気に入ってます。歌がうまくて感情がこもっているし、繊細なピアノもいい。どうもSunoは歌詞の内容を理解して曲の展開や表現を決めているように思えるのです。つまり、元絵からAIが想像して作った歌詞が、曲やボーカルの表現をエモいものにしていると。

今度は自分のボーカルもがんばって、妻の歌声に変換した「歌ってみた」もやってみようかと思ってます。AIシンガーに負けないように。

画像、テキスト、音楽というトリオ編成(ELPのように)がけっこう上手くいった気が。

昨日からXでは「Suno AI」がトレンド入りしており、多くの人がAI作曲を楽しんでいるようです。歌詞作りにChatGPTなどを使うにしてもプロンプトが思いつかないという人は、写真やイラストなどを見せてみるという手はいかがでしょうか? マルチモーダルなLLMは意外にいい詩人みたいですよ。

最新の制作方法はこちら。