Sora世代のオープンソース動画生成AIとして話題の「CogVideo」をローカルマシンにインストールしてみました。正確には、CogVideoを発展させたCogVideoXを含むCogStudioというソフトです。

CogVideoは最近進化が著しく、直近ではRunwayやLuma Dream Machineなどと同様に画像を起点に動画生成できる「Image to Video」もサポートするようになったのですが、これが超簡単にインストールできたので、今回はその方法をお伝えします。

■Pinokioって知ってますか?

GitHubなどで次々と公開されている新しい生成AI技術は、自分で試せるのが素晴らしいところ。商用サービスと違い、ローカルマシンで動かせるので、NSFWや理由不明の生成制限に煩わされることはありません。電気代以外のお金もかかりません。

その一方で、自分のマシンにインストールするにはPythonや依存ライブラリのバージョンを気にかけながらターミナルをいじる必要があります。Windowsであれば、簡単なインストーラーを用意してくれることもありますが、それはだいぶこなれてきてからのこと。すぐに使いたい、というニーズには応えてくれません。

開発者の立場からしたら、そんな時間があったらバージョンアップに時間を割きたい、といったところでしょう。Hugging Faceで試せるようにしたからいいよね、で終わってしまうことも少なくありません。

筆者のようなノンプログラマーの場合、自分でターミナルを駆使するのにも限界があります。他の方のブログや動画を見ながらやってはきましたが、依存ライブラリのバージョンアップが入ったりするとうまくいかないことも多いのです。

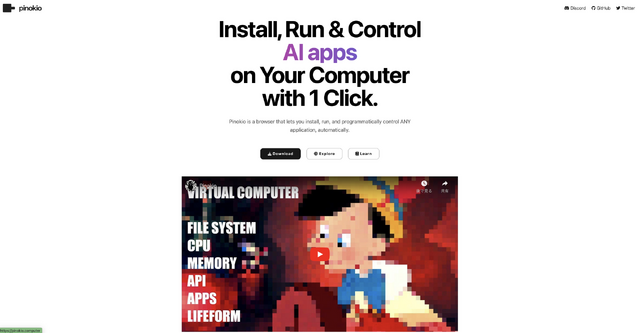

さて、そんな筆者がしばらく前から使っているのが「Pinokio」というAI専用仮想環境です。さまざまなAIプログラムをローカルマシンにインストールするためのソフトウェアで、スクリプトを起動すれば、あとはほぼ自動でインストールし、実行してくれます。

▲Pinokioのトップページ

サイトには次のような説明があります。

ローカル:すべてがローカルでインストールされ、実行されます。あなたのデータは他の誰かのサーバに保存されることはありません。

無料:Pinokioはオープンソースのアプリケーションで、100%無料で使用できます。APIアクセスのために誰かにお金を払う必要はなく、すべてがあなたのローカルマシンで実行されます。AIを自由に扱うことができ、永遠に無料です。

プライベート:AIを実行するためにプライベートなデータを提出する必要はありません。すべてが100%プライベートにあなたのマシン上で実行されます。

ユーザーフレンドリーなインターフェース:Pinokioは、通常はターミナルを使用しなければならないタスクを実行および自動化するための使いやすいGUIを提供します。

バッテリー込み(これだけで完結):Pinokioは自己完結型のシステムです。他のプログラムをインストールする必要はありません。Pinokioは、プログラムやライブラリのインストールを含む、あらゆるものを自動化できます。必要なのはPinokioだけです。

クロスプラットフォーム:Pinokioはすべてのオペレーティングシステム(Windows、Mac、Linux)で動作します。

ストレージとリソースを節約:Pinokioには、数百ギガバイトのディスクスペースを節約する多くの最適化機能があります。メモリなど、他のリソース最適化機能もPinokioで可能です。

表現力豊かなスクリプト言語:Pinokioスクリプトは、メモリ、動的テンプレート、拡張可能な低レベルAPIなどの機能を備えた強力な自動化スクリプト言語です。

ポータブル:すべてが隔離されたフォルダ内に保存され、すべてがファイルとして存在するため、簡単にバックアップを取ったり、ファイルを削除するだけでアプリを削除できます。

ローカルマシンにPinokioをインストールしておけば、スクリプトが対応しているオープンソースプログラムを簡単にインストールし、実行もできるというわけです。

筆者はこれまでAUTOMATIC1111、ComfyUI、SwarmUIなどの画像生成AIをインストールし、使ってきました。それぞれのプログラムの起動・終了もボタン一発なので、管理もしやすいというメリットがあります。

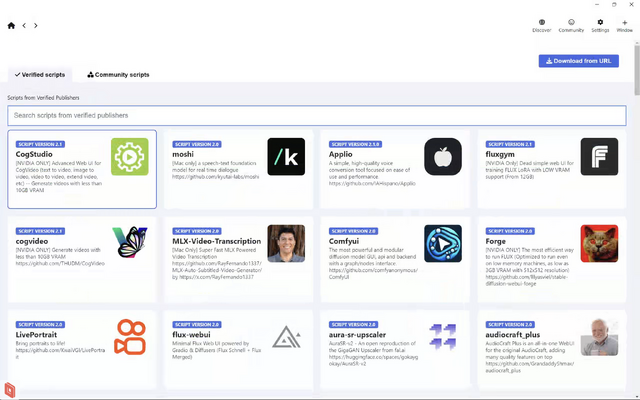

そんなPinokioがCogVideoに対応したというXの投稿が今朝、ありました。

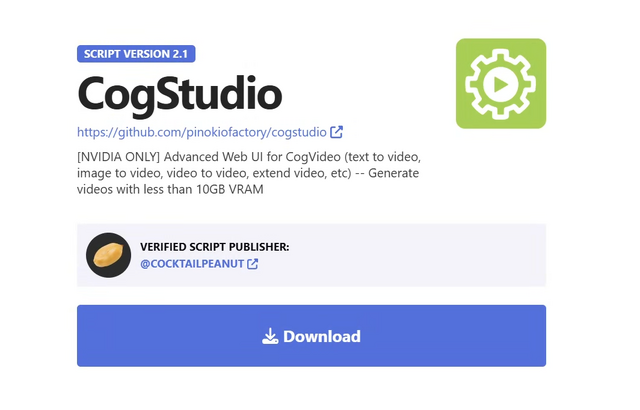

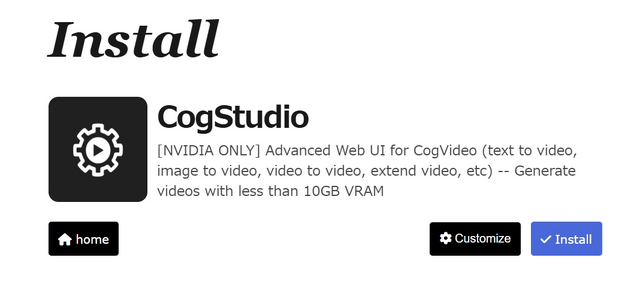

しかも単に「CogVideoが動きました」ではなく、Image to Video、Video to Video、Extend Videoも含んだ総合スイート「CogStudio」として実装しているというのです。

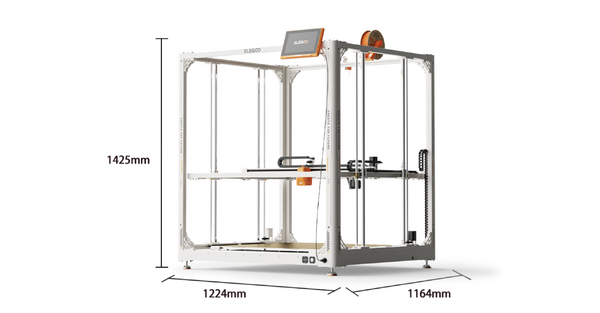

現在はNVIDIA GPU専用となっていますが、そういう時のためのGeForce RTX4090。頑張ってもらいましょう。さあ、インストールです。

■Core i7 + 4090マシンにCogVideoをインストール

インストールといっても、Pinokioのホーム画面に置かれているスクリプトの中から目的のものを探してクリックするだけです。

最新のところにCogStudioがありました。まずはスクリプトをダウンロードしてインストール。

VRAMが10GB未満でも動作するとあります。

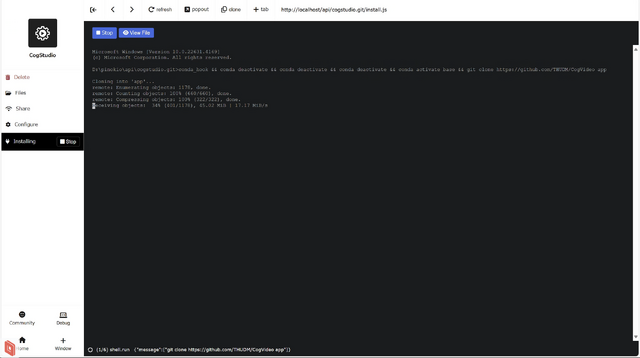

インストール中はターミナルが表示されますが、途中、自分で操作する必要はありません。

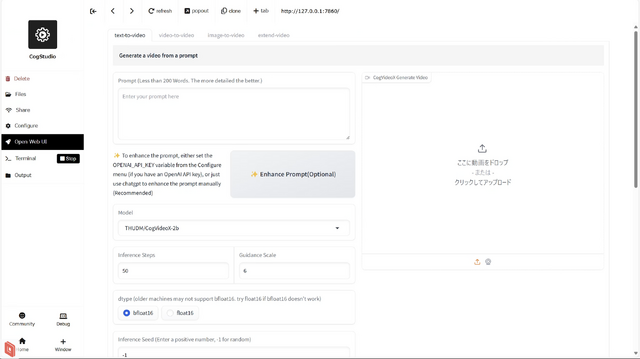

15分ほどでインストールが完了し、そのままGradioのWeb UI画面になりました。もう操作が可能です。

■CogStudio(CogVideo)をText to Videoで使ってみる

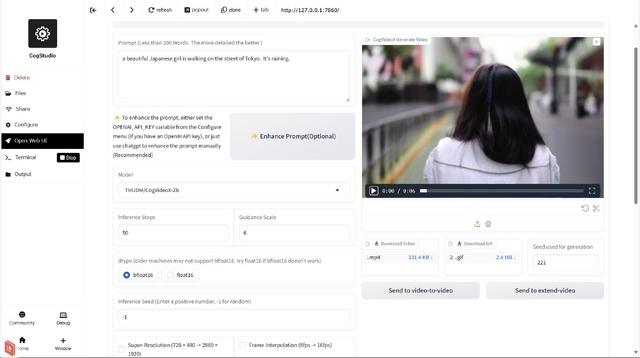

まずはText to Videoをデフォルトの状態で試してみます。フレームレートは1秒8フレームでフレーム補完は使っていません。アップスケーラーも不使用です。モデルは2Bと5Bが選択できますが、今回は2Bで始めてみます。

後ろ姿ですが、悪くない感じです。

しかし、美しい日本人女性と指定したら、前から見るとこんな感じに。初期のStable Diffusionを思い出してしまいました。

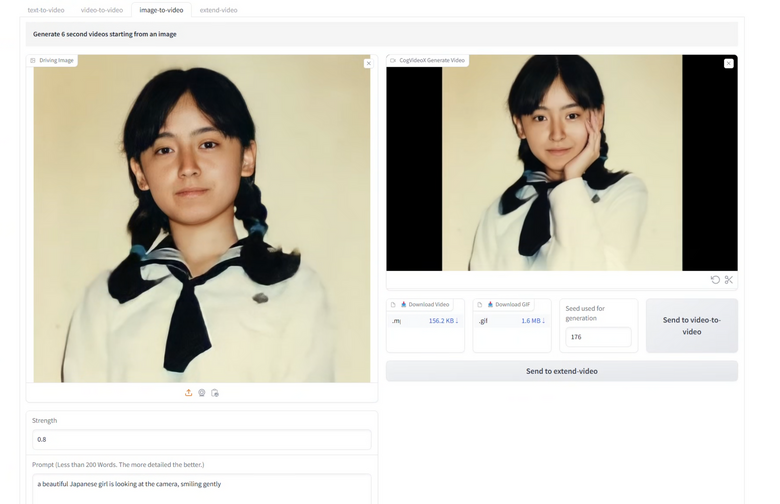

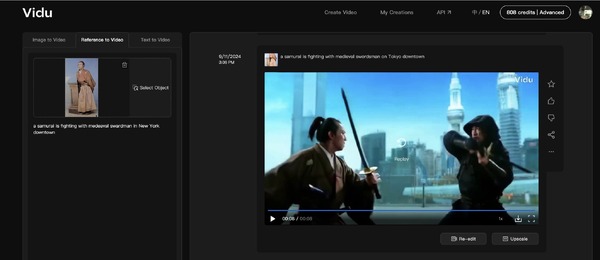

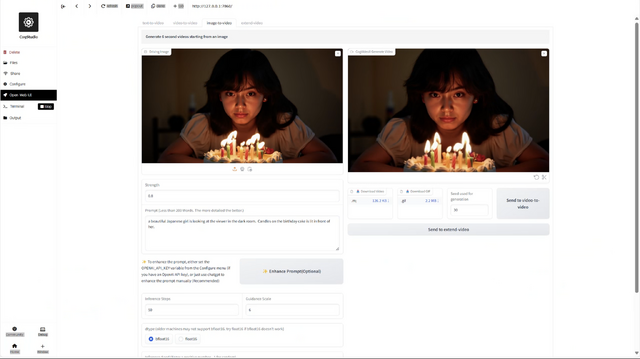

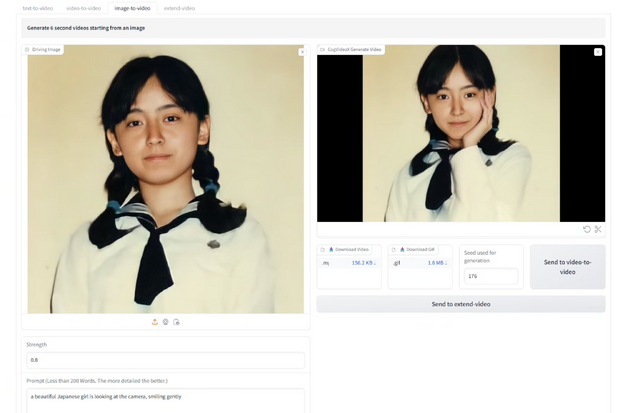

■CogVideoのImage to Videoを使ってみた

やはり、画像を参照するImage to Videoがあった方が良さそうです。

こちらも、Image to Videoのタブに切り替えればすぐに使えます。

▲Image to Videoの操作画面

同じ秒間8フレーム、アップスケールなしの条件で、FLUX.1 [dev] LoRAによる参照画像あり(Image to Video)で生成してみました。生成した動画は、MP4とGIFの両方でダウンロードできるのが何気に便利です。

こちらはかなり自然。フレーム補完とアップスケーラーを使う、もしくはTopaz Video AIなどの優秀な外部AIアップスケーラーを使うとさらに良い結果となります。

ただ一つの問題は、生成に非常に時間がかかること。初回は6秒8FPSの画像でも、4090マシンで25分を要しました。

2回目、同じ解像度の別画像で試したところ、こちらは9分30秒と、短縮されました。キャッシュが効いているからでしょうか。その後も同じくらいの所要時間です。フレームレートが低いせいでカクカクですが、動き自体はさほど違和感ありません。

目の動きなど、少なくとも現在のPikaより良いのではないでしょうか(眼球がキョロキョロ不自然に動く)。

ちなみに、16FPSにしたところ、途中でエラーとなったため、8FPSに戻しました。

元画像は720×480と同比率でなくても生成できますが、生成されるのは720×480で、黒枠付きとなります。指の動きなどはRunwayよりもいい感じです。

人物Image to Videoの動きや表情の変化に関しては、商用サービスと比べても自然に思えます。解像度とフレームレートはまだまだですが。

今後はさらなる高速化技術も出てくるでしょうし、ブラシコントロールなど、他の商用動画生成AIサービスで導入されている技術もCogStudioに取り込まれるのではないでしょうか。

Runway Gen-3 Alpha Turboは10秒の24フレーム動画を10秒ちょっとで生成できるわけですが、ローカルマシンで現時点でここまでできれば上出来と言えます。

商用サービスである限り、生成内容には制限が課せられます。異議申し立てできる場合もありますが、ほとんどの場合、受け入れてはくれません。自分で成果物をコントロールできるメリットは大きいです。

メインがRunwayであるのはしばらく変わらないとは思いますが、いざという時には頼れるソフトが自分のマシンで動くのは非常に心強いです。

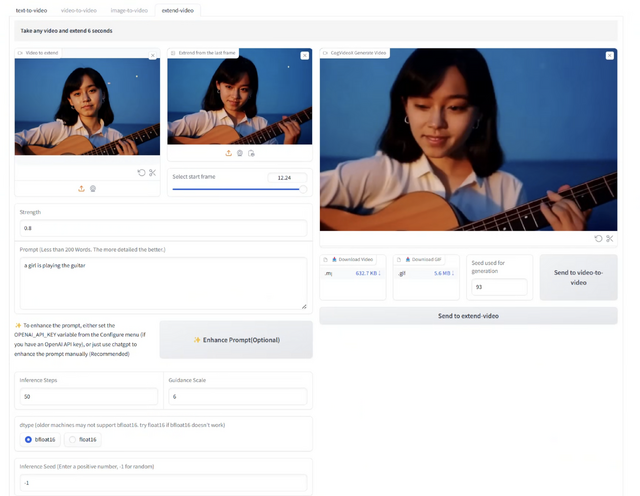

Extend Videoもやってみました。2回延長した画像がこちら。これで18秒です。

Topaz Video AIでフレーム補完とアップスケールした動画はこちらです。

¥366,000

(価格・在庫状況は記事公開時点のものです)

¥328,078

(価格・在庫状況は記事公開時点のものです)

¥591,880

(価格・在庫状況は記事公開時点のものです)